Kurzfassung

▾

Quellen

▾

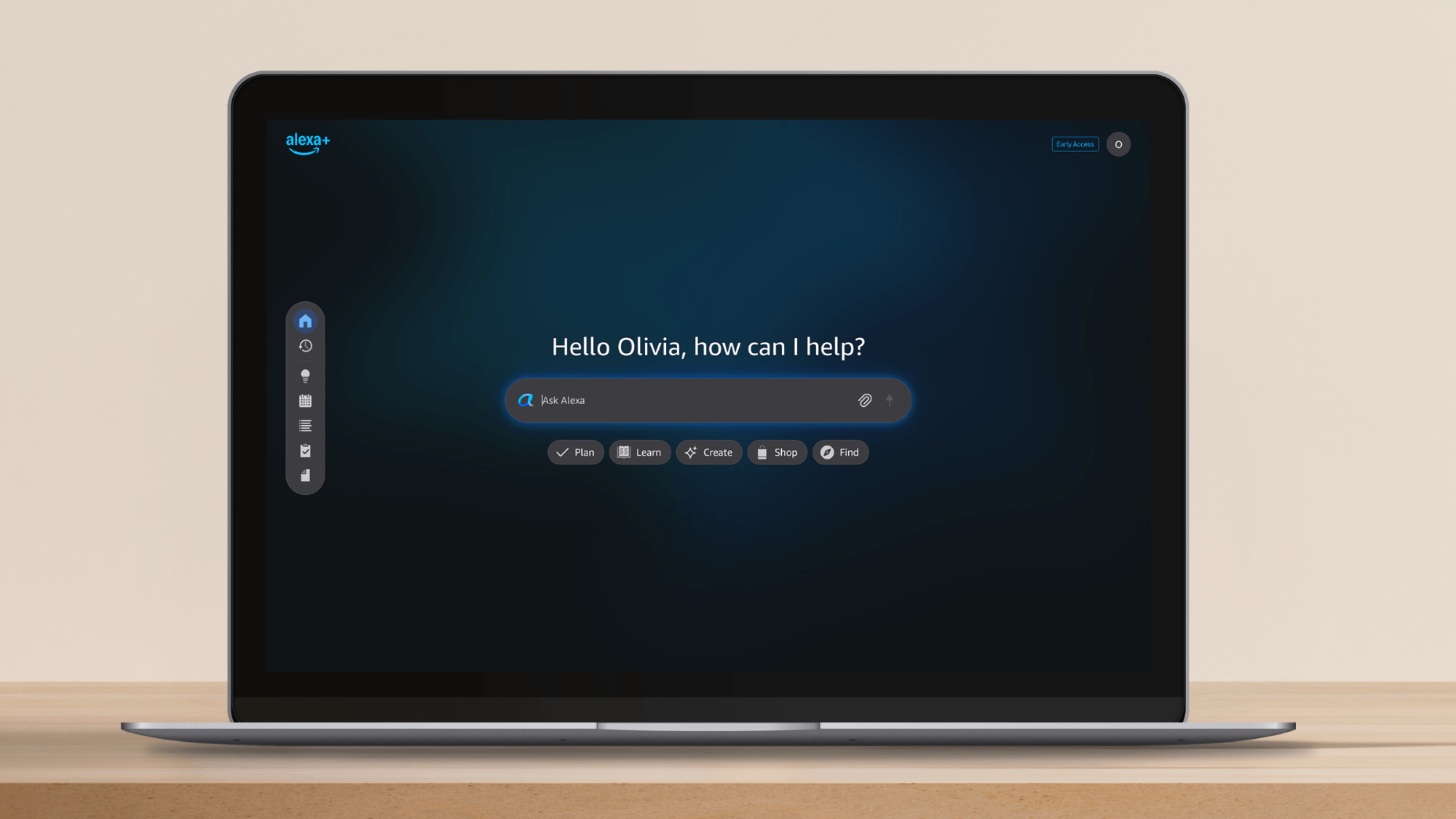

Google führt das Universal Commerce Protocol ein, um KI-Agenten das autonome Einkaufen und den Abruf von Echtzeit-Produktdaten zu ermöglichen. Nutzer können ab sofort Produkte von Partnern wie Walmart und Shopify direkt innerhalb der Gemini-App und der Google Suche bezahlen. Um die KI-Suche profitabel zu machen, integriert Google nun kontextbezogene Shopping-Anzeigen direkt in die generierten Chat-Antworten.

TechCrunch: Google announces a new protocol to facilitate commerce using AI agents.

Google Developers Blog: Under the Hood: Universal Commerce Protocol (UCP).

9to5Google: Gemini app and Google AI Mode adding product checkout.

Shopify News: Shopify connects any merchant to every AI conversation.

Google definiert mit dem Universal Commerce Protocol neu, wie KI-Modelle und Online-Shops interagieren. Nutzer können Produkte künftig direkt im Chat kaufen, während Händler sich auf eine Ära autonomer KI-Käufer einstellen müssen. Das Ende der klassischen Produktsuche Google läutet die Ära des „Agentic Commerce“ ein. Künstliche Intelligenz soll nicht mehr nur Informationen liefern, sondern komplexe Aufgaben wie den Wocheneinkauf aktiv erledigen. Das Fundament hierfür bildet das neu vorgestellte Universal Commerce Protocol (UCP). Dieser offene Standard ermöglicht es KI-Agenten, Produktinformationen in Echtzeit abzurufen und Transaktionen selbstständig durchzuführen. Händler müssen ihre Daten nicht mehr für jede KI einzeln aufbereiten. Das Protokoll standardisiert den Austausch zwischen Shops und verschiedenen KI-Modellen. Die Verwaltung des Standards übernimmt die Linux Foundation, was eine breite Akzeptanz in der Industrie sichern soll. Google positioniert UCP als die Lingua Franca für den maschinellen Handel der Zukunft. Anzeige Checkout direkt im Chat Nutzer profitieren in der Gemini-App und im „AI Mode“ der Google-Suche von neuen Kaufoptionen. Der Checkout-Prozess findet unmittelbar in der Konversation statt, ohne dass die Plattform verlassen werden muss. Ein Medienbruch entfällt, was die Hürde zwischen Produktentdeckung und Kaufabschluss signifikant senkt. Die hinterlegten Zahlungsdaten im Google-Konto ermöglichen dabei eine reibungslose Abwicklung. Zum Start kooperiert Google mit US-Handelsriesen wie Walmart und Wayfair sowie der E-Commerce-Plattform Shopify. Shopify-Händler erhalten damit automatisch Zugang zu Millionen von potenziellen KI-Konversationen. Walmart nutzt die Partnerschaft, um personalisierte Nachbestellungen direkt über Gemini abzuwickeln, was die Kundenbindung im KI-Zeitalter stärken soll. + Quelle: Google Monetarisierung durch Shopping-Ads Google monetarisiert die KI-Suche mit diesem Schritt aggressiver. Relevante Shopping-Anzeigen erscheinen künftig direkt in den Antworten von Gemini. Sucht ein Nutzer nach spezifischen Produkten wie Laufschuhen, werden passende Kaufvorschläge inklusive Preis und Bild eingeblendet. Dies markiert einen wichtigen Schritt für Google, um sinkende Einnahmen aus der klassischen Suche zu kompensieren. Für Werbetreibende eröffnet sich ein Kanal abseits der Suchleiste. Die Integration erfolgt kontextbezogen und soll sich organisch in den Dialog mit der KI einfügen. Kritiker dürften jedoch genau beobachten, wie stark die kommerziellen Interessen die Neutralität der KI-Antworten beeinflussen.