Nano Banana

Kurzfassung

▾

Quellen

▾

Yann LeCun verlässt Meta aufgrund eines fundamentalen Konflikts über die Zukunft der KI, da er Large Language Models (LLMs) als technologische Sackgasse betrachtet. Mit seinem neuen Startup AMI Labs setzt er auf „World Models“ und die JEPA-Architektur, um KIs zu entwickeln, die physikalische Gesetze verstehen und logisch planen können. Der Schritt ermöglicht ihm Forschung ohne bürokratische Hürden und kommerziellen Druck, wobei er gezielt Top-Talente für den Standort Europa rekrutiert. AMI Labs strebt eine Bewertung von 3,5 Milliarden Dollar an und positioniert sich als direkter Gegenentwurf zu den textbasierten Modellen von OpenAI und Google.

Le Monde: Yann Le Cun: ‚Why I’m leaving Meta to launch my own AI start-up‘

ByteIota: World Models Race 2026: LeCun’s €500M Bet Against LLMs

Stratégies: Laurent Solly rejoint AMI Labs

Sifted: Yann LeCun Poaches from Meta, Google DeepMind for New Startup

Fortune: AI Whiz Yann LeCun is Already Targeting a $3.5 Billion Valuation

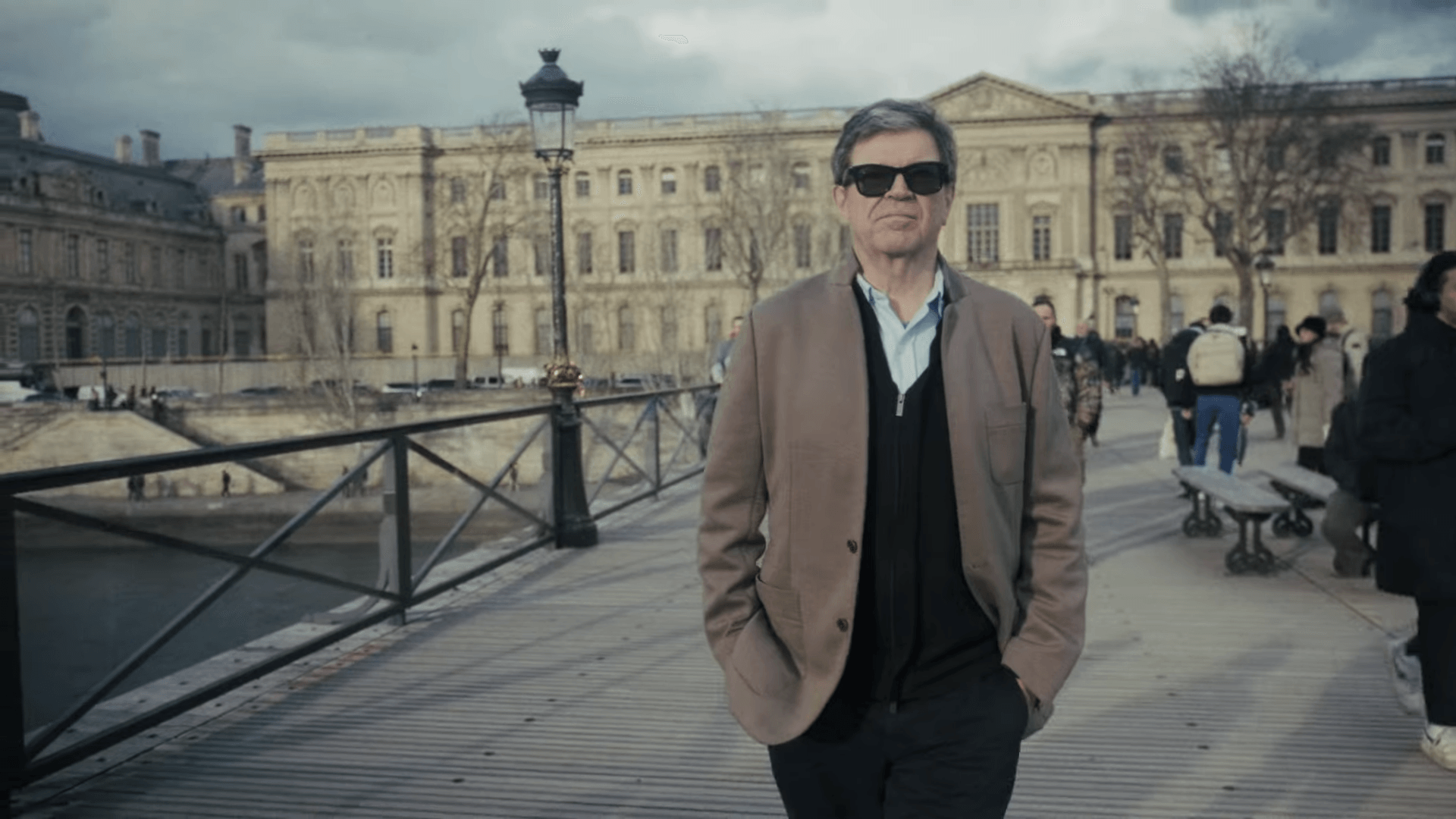

Yann LeCuns Ausstieg bei Meta ist kein gewöhnlicher Karrierewechsel, sondern das Resultat eines jahrelangen ideologischen Konflikts über die Zukunft der KI-Entwicklung. Der „Godfather of AI“ zieht die Reißleine, weil er die aktuelle Fixierung der Tech-Branche auf Sprachmodelle für einen kostspieligen Irrweg hält. Sackgasse Generative KI Der Hauptgrund für LeCuns Abgang liegt in seiner tiefen Skepsis gegenüber der Technologie, die Meta aktuell mit Milliardeninvestitionen vorantreibt. Während Mark Zuckerberg die „Llama“-Modelle als Kernprodukt des Konzerns positioniert, bezeichnet LeCun die zugrundeliegende Architektur der Large Language Models (LLMs) intern wie extern als Sackgasse. Für ihn sind diese Systeme, die lediglich das nächste Wort basierend auf Wahrscheinlichkeiten vorhersagen, nicht in der Lage, echte Intelligenz oder logisches Denken zu entwickeln. In aktuellen Interviews zur Gründung seines Startups AMI Labs wird deutlich, dass LeCun sich bei Meta zunehmend in einer technologischen Zwangsjacke befand. Zwar leitete er die Forschung, doch der kommerzielle Druck zwang den Konzern, auf den generativen KI-Hype aufzuspringen, um den Anschluss an OpenAI und Google nicht zu verlieren. LeCun hingegen wollte Ressourcen radikal umschichten – weg von Textgeneratoren, hin zu Systemen mit echtem Weltverständnis. Dieser fundamentale Strategiekonflikt ließ sich innerhalb der Konzernstrukturen nicht mehr auflösen. Anzeige Die Vision der „World Models“ LeCuns Motivation für den Neustart ist der Drang, seine theoretische Arbeit an sogenannten „World Models“ (Weltmodellen) endlich in die Praxis umzusetzen. Er ist überzeugt, dass eine KI erst dann nützlich ist, wenn sie physikalische Gesetze, Kausalitäten und die Permanenz von Objekten versteht. Aktuelle LLMs halluzinieren, weil sie keinen Bezug zur Realität haben. LeCun will mit AMI Labs eine Architektur schaffen, die plant und denkt, bevor sie antwortet. Diesen Ansatz der „Joint Embedding Predictive Architecture“ (JEPA) konnte er bei Meta nur als Forschungsprojekt betreiben, nicht aber als zentrales Produkt. Um zu beweisen, dass sein Ansatz den LLMs überlegen ist, benötigt er die volle Kontrolle über Rechenkapazitäten und Talente. Sein neues Startup dient ihm als Vehikel, um diese These ohne Rücksicht auf bestehende Produktlinien wie Instagram oder WhatsApp zu verifizieren. Forschung ohne Fesseln Ein weiterer entscheidender Faktor für den Wechsel ist die Geschwindigkeit der Umsetzung. LeCun kritisierte zuletzt häufiger die bürokratischen Hürden und Sicherheitsbedenken großer Tech-Konzerne, die innovative Sprünge verlangsamen. In einem unabhängigen Startup wie AMI Labs entfällt der Rechtfertigungsdruck gegenüber Aktionären, die kurzfristige Profite durch generative KI-Features erwarten. Zudem zieht es LeCun zurück nach Europa, um ein Gegengewicht zum Silicon Valley zu etablieren. Er nutzt sein persönliches Netzwerk, um Top-Forscher von DeepMind und Meta abzuwerben, die seine Skepsis gegenüber dem aktuellen Hype teilen. Mit einer initialen Bewertung von angepeilten 3,5 Milliarden Dollar schafft er sich die finanzielle Unabhängigkeit, um seine Vision einer „Physischen KI“ gegen den Mainstream durchzusetzen.