Nano Banana

Kurzfassung

▾

Quellen

▾

Google DeepMind veröffentlicht AlphaGenome zur Analyse der bisher unverstandenen nicht-kodierenden Bereiche der menschlichen DNA. Das KI-Modell verarbeitet Sequenzen von bis zu einer Million Basenpaaren und erkennt komplexe regulatorische Zusammenhänge. Wissenschaftler können ab sofort über GitHub auf den Quellcode zugreifen, um die Erforschung von Erbkrankheiten zu beschleunigen.

Google alphagenome auf Github

BBC News: AI model from Google DeepMind reads recipe for life in our DNA

Nature Artikel

Phys.org: Google unveils AI tool probing mysteries of human genome

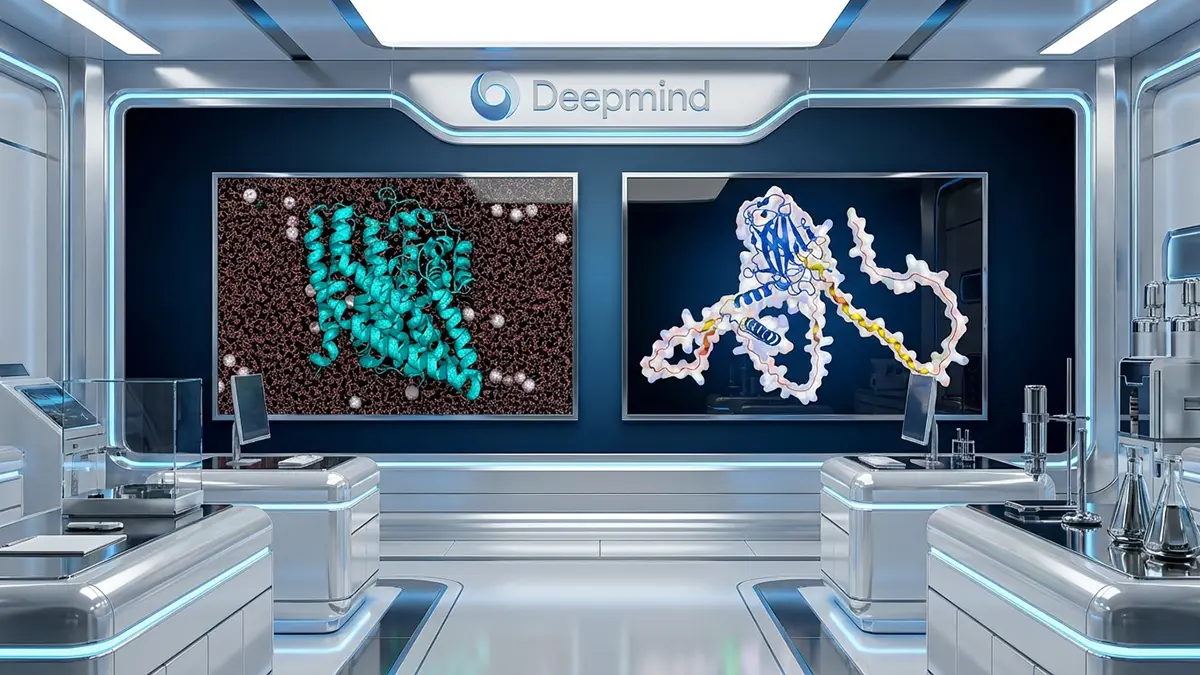

Google DeepMind stellt AlphaGenome vor und liefert ein KI-Modell zur Analyse der nicht-kodierenden DNA. Das System prognostiziert präzise, wie genetische Veränderungen die Genregulation steuern und steht der Wissenschaft ab sofort als Open-Source-Lösung zur Verfügung. Eine Million Basenpaare im Kontext Moderne Sprachmodelle verarbeiten riesige Textmengen, AlphaGenome überträgt dieses Prinzip nun auf die menschliche Biologie. Das Modell analysiert DNA-Sequenzen mit einer Länge von bis zu einer Million Basenpaaren gleichzeitig. Bisherige Verfahren scheiterten oft an der komplexen Struktur des menschlichen Genoms. Wichtige regulatorische Elemente liegen oft weit von dem Gen entfernt, das sie eigentlich steuern. AlphaGenome überbrückt diese Distanz und erkennt funktionale Zusammenhänge über riesige genetische Entfernungen hinweg. Die Architektur basiert auf spezialisierten Mechanismen, die Effizienz und Genauigkeit bei der Sequenzverarbeitung kombinieren. Das System lernt die Grammatik der DNA ähnlich wie ein LLM die menschliche Sprache lernt, benötigt dafür aber keine vorab definierten Annotationen. Anzeige Licht in die regulatorische Dunkelheit Nur etwa zwei Prozent der DNA enthalten direkte Baupläne für Proteine. Der weitaus größere Rest gilt als sogenannte „dunkle Materie“ und steuert, wann und wo Gene aktiviert werden. AlphaGenome kartiert diese regulatorischen Netzwerke nun mit einer bisher unerreichten Präzision. Das Modell sagt voraus, wie stark ein Gen in verschiedenen Gewebetypen exprimiert wird. Es erkennt Enhancer und Promotoren allein anhand der rohen Sequenzdaten. Diese Vorhersagekraft übertrifft bisherige Standardverfahren deutlich und liefert tiefere Einblicke in die zelluläre Logik. Ein zentraler Anwendungsfall ist die Bewertung von Punktmutationen. Das Tool berechnet, ob der Austausch eines einzelnen Buchstabens im genetischen Code krankhafte Folgen hat oder harmlos bleibt. Dies ist entscheidend für die Interpretation von Daten aus großen Patientenstudien und der Suche nach Ursachen für komplexe Erbkrankheiten. Wissenschaftliche Validierung und Zugang Die Veröffentlichung der Ergebnisse erfolgt parallel zu einem Peer-Review-Artikel im renommierten Fachjournal Nature. DeepMind stellt den vollständigen Quellcode und die Modellgewichte ab sofort auf GitHub bereit. Damit entfällt die Hürde proprietärer Softwarelizenzen für akademische Labore und unabhängige Forscher. Wissenschaftler können das Modell lokal betreiben oder für spezifische Analysen anpassen. Die breite Verfügbarkeit soll die Entdeckung neuer Wirkstoffziele in der Pharmaindustrie beschleunigen. AlphaGenome ergänzt damit AlphaFold, das die Proteinstruktur löste, um die entscheidende Ebene der genetischen Steuerung. Anzeige