OpenAI

Kurzfassung

▾

Quellen

▾

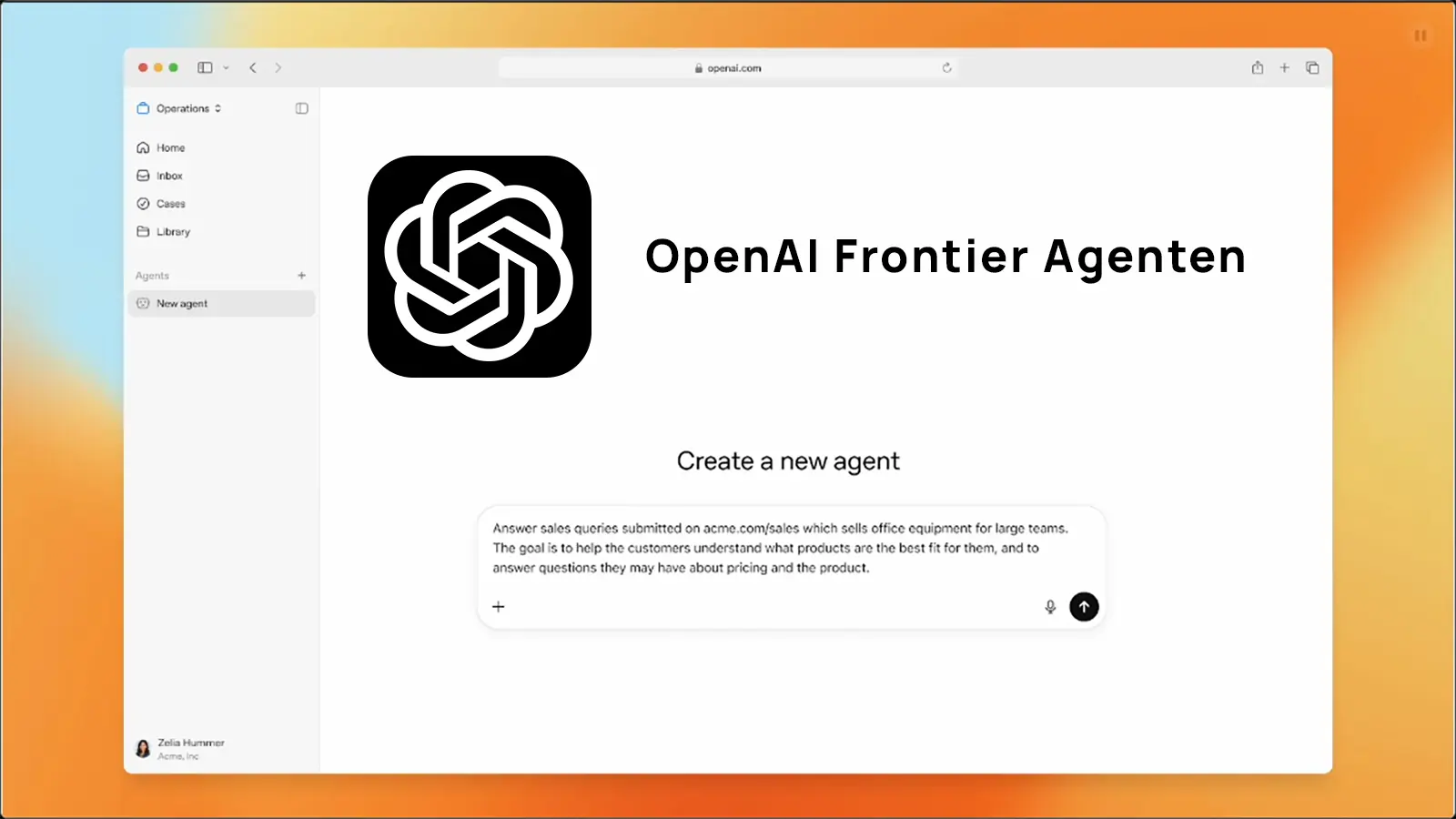

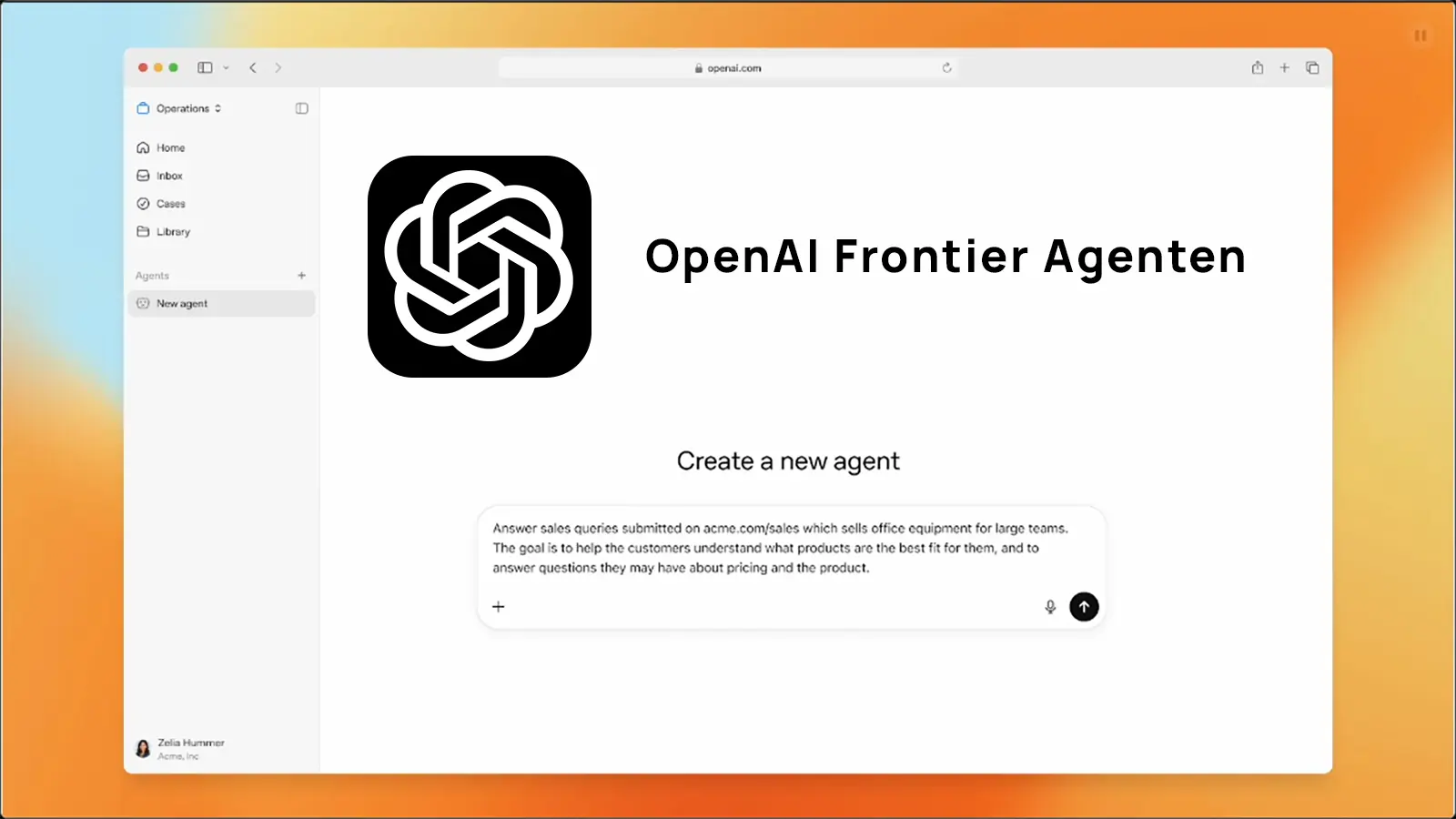

OpenAI veröffentlicht mit Frontier eine Enterprise-Plattform, die Unternehmen das Erstellen, Verwalten und Überwachen von autonomen KI-Agenten ermöglicht. Die neue Lösung fokussiert sich auf Sicherheit und Kontrolle, sodass IT-Abteilungen genaue Zugriffsrechte und Regeln für die digitalen Mitarbeiter festlegen können. Die Agenten agieren als „AI Coworkers“, die komplexe Prozessketten eigenständig abarbeiten, statt nur auf Chat-Eingaben zu reagieren. Zum Start demonstriert der Versicherungskonzern State Farm bereits den praktischen Einsatz der Plattform zur Automatisierung administrativer Aufgaben.

OpenAI – Introducing OpenAI Frontier

Reuters – OpenAI unveils AI agent service as part of push to attract businesses

The Verge – OpenAI Frontier is a single platform to control your AI agents

CNBC – OpenAI launches Frontier in bid to win more business customers

X (OpenAI) – Introducing OpenAI Frontier (Offizieller Post)

OpenAI fokussiert sich stärker auf Geschäftskunden und startet mit Frontier eine umfassende Enterprise-Plattform. Unternehmen erhalten damit ein Werkzeug, um autonome KI-Agenten nicht nur zu erstellen, sondern diese auch zentral zu verwalten und sicher in bestehende Arbeitsabläufe zu integrieren. Vom Chatbot zum autonomen Kollegen Der Fokus der KI-Entwicklung verschiebt sich weg vom reinen Dialog hin zur aktiven Ausführung von Aufgaben. Frontier dient dabei als technisches Fundament für sogenannte „AI Coworkers“. Diese Agenten agieren eigenständiger als bisherige Modelle und übernehmen komplexe, mehrstufige Prozessketten. Sie buchen Termine, analysieren Datensätze oder stoßen Bestellvorgänge an, ohne dass jeder einzelne Schritt eine menschliche Bestätigung erfordert. OpenAI liefert mit der Plattform die nötige Infrastruktur, um diese digitalen Mitarbeiter spezialisiert auf spezifisches Firmenwissen zu trainieren und zu deployen. + Quelle: OpenAI Zentrale Steuerung und Sicherheit Ein Hauptproblem bei der bisherigen Integration von KI in Firmennetze war die fehlende Übersicht über autonome Prozesse. Frontier adressiert diesen Punkt durch ein zentrales Management-Dashboard für die IT-Abteilung. Administratoren legen hier präzise fest, auf welche internen Datenbanken ein Agent zugreifen darf und welche Aktionen explizit untersagt sind. Das System protokolliert Entscheidungen der KI transparent und nachvollziehbar. Fehlerquellen oder unerwünschtes Verhalten lassen sich so schnell identifizieren und korrigieren. Für Unternehmen senkt das die Hürde, generative KI auch in sensiblen Bereichen einzusetzen, da interne Compliance-Vorgaben technisch durchgesetzt werden. Die IT behält die Hand auf dem Ausschalter, während die Fachabteilungen die Agenten nutzen. Anzeige Erster Praxiseinsatz bei State Farm Wie die Plattform in der Realität funktioniert, zeigt der Startpartner State Farm. Der US-Versicherer nutzt Frontier bereits aktiv, um Routineaufgaben in der Schadensabwicklung zu automatisieren. Agenten übernehmen hier die Vorprüfung von Dokumenten und entlasten die menschlichen Sachbearbeiter von administrativen Tätigkeiten. Die Kooperation verdeutlicht OpenAIs Strategie: Weg von experimentellen Spielwiesen, hin zu skalierbaren Anwendungen, die direkten wirtschaftlichen Nutzen bringen. Konkurrenzdruck und Marktposition Der Launch erfolgt in einer Phase intensiven Wettbewerbs. Während Konkurrenten wie Anthropic ebenfalls an Agenten-Systemen arbeiten, versucht OpenAI durch die Enterprise-Ausrichtung Fakten zu schaffen. Dass der Kampf um Marktanteile härter wird, zeigt auch die aktuelle Werbepräsenz rund um den Super Bowl. Frontier ist der Versuch, sich als unverzichtbares Betriebssystem für Unternehmens-KI zu positionieren, bevor andere Anbieter ähnliche Infrastrukturen etablieren können.