Nano Banana

Kurzfassung

▾

Quellen

▾

Google führt mit „AI Plus“ für 8,99 Euro pro Monat (Startangebot 3,99 Euro) eine neue Abo-Stufe zwischen der Gratis- und Pro-Version ein. Nutzer erhalten Zugriff auf das leistungsstarke Gemini 3 Pro Modell, Deep Research Funktionen sowie Tools zur Bild- und Videogenerierung. Im Vergleich zum teureren Pro-Abo fehlen die Integration in Google Workspace Apps (Gmail, Docs) und das Punkte-Guthaben für Medien-Tools ist reduziert.

Google AI Plus Blog Eintrag

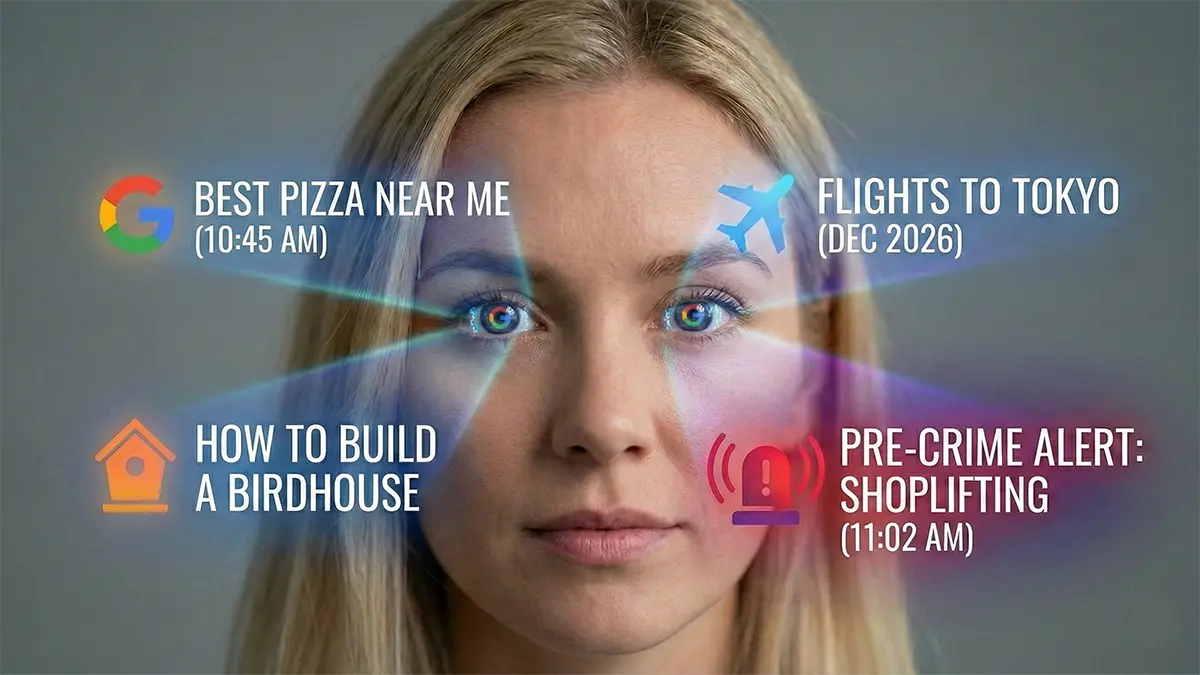

Google führt eine neue Abo-Stufe für seine KI-Dienste in Deutschland ein. Mit „Google AI Plus“ gibt es erstmals einen Mittelweg zwischen der Gratis-Version und dem teuren Premium-Abo, der Zugriff auf leistungsfähigere Modelle bietet. Angriff auf die Mittelklasse Der neue Tarif kostet regulär 8,99 Euro im Monat. Zum Start bietet Google das Abo in den ersten zwei Monaten für jeweils 3,99 Euro an. Nutzer erhalten damit dauerhaften Zugriff auf das leistungsstarke Modell Gemini 3 Pro sowie Deep Research Funktionen. Bislang mussten Anwender für diese Leistungsklasse entweder mit starken Einschränkungen in der Gratis-Version leben oder direkt 21,99 Euro für das Pro-Abo zahlen. Das neue Angebot zielt damit auf Nutzer, denen das Standard-Modell Gemini 3 Flash nicht mehr ausreicht, die aber keine vollwertige Office-Integration benötigen. Anzeige Wo die Grenzen liegen Der günstigere Preis geht mit klaren Einschränkungen gegenüber der Pro-Variante einher. Während das teurere Abo unbegrenzten Zugriff auf diverse Funktionen verspricht, arbeitet Google hier mit einem Punkte-System. Für die Videogenerierung in Flow und Whisk stehen monatlich 200 KI-Guthabenpunkte zur Verfügung. Im Vergleich dazu bietet das „Google AI Pro“-Abo 1.000 Punkte und das Ultra-Abo sogar 25.000 Punkte für rechenintensive Aufgaben. Ein weiterer wichtiger Unterschied ist das Fehlen der Integration in Gmail, Docs und andere Workspace-Apps. Wer KI direkt in seinen Dokumenten nutzen oder E-Mails zusammenfassen lassen möchte, muss weiterhin zum teureren Tarif greifen. + Quelle: Google Der Vergleich zum Wettbewerb Das Plus-Abo enthält auch Zugriff auf neuere Kreativ-Tools. Die Bildgenerierung mit Nano Banana Pro ist ebenso enthalten wie ein eingeschränkter Zugriff auf den Videogenerator Veo 3.1. In der kostenlosen Version sind Nutzer primär auf Gemini 3 Flash beschränkt und erhalten nur zeitweise Zugriff auf die Pro-Modelle. Google reagiert mit diesem Schritt auf die wachsende Konkurrenz durch „Light“-Abos anderer Anbieter wie OpenAI, die ähnliche Zwischenstufen testen. Für Gelegenheitsnutzer bleibt die kostenlose Variante attraktiv. Wer jedoch regelmäßig komplexe Analysen fährt oder Deep Research nutzt, findet nun für unter 10 Euro eine valide Option.