ElevenMusic

Kurzfassung

▾

Quellen

▾

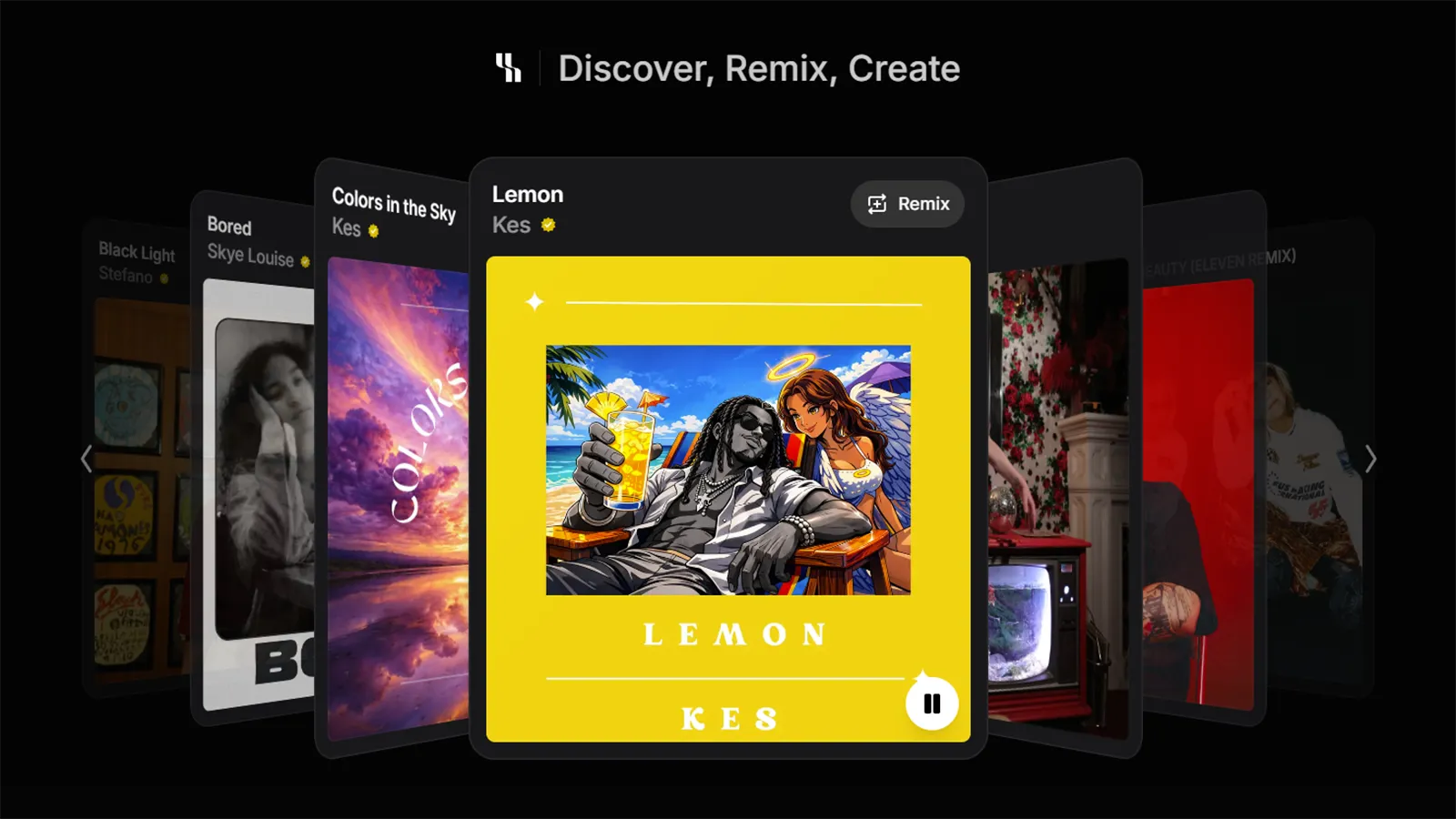

ElevenLabs hat mit ElevenMusic eine neue Plattform gestartet, die das Generieren von KI-Musik mit einem eigenen Streaming-Dienst verbindet.

Nutzer profitieren von sehr günstigen Tarifen mit bis zu 400 Tracks für 9,99 US-Dollar, dürfen die Lieder aber ausschließlich intern auf der Plattform nutzen.

Wer durch seine erstellten Songs oder Remixe eine hohe Reichweite innerhalb der App erzielt, wird von ElevenLabs finanziell vergütet.

ElevenLabs Blog – Introducing ElevenMusic

ElevenMusic – Offizielle Webplattform

ElevenLabs startet mit ElevenMusic ein eigenständiges Portal, welches die Erstellung von KI-Musik direkt an einen Streaming-Dienst koppelt. Konsumenten generieren dort nicht nur eigene Songs, sondern erzielen durch Aufrufe ihrer Titel auch finanzielle Einnahmen.

Angepasstes Preismodell bei limitierter Lizenzierung Gegenüber der Hauptplattform senkt der Anbieter die Kosten für das Generieren von Audiospuren drastisch. Kostenlos erzeugen die KI-Modelle für jeden Account täglich sieben neue Tracks. Wer ein monatliches Abonnement für 9,99 US-Dollar abschließt, sichert sich ein Kontingent von 400 Liedern. Zum Vergleich liefert das reguläre System für denselben Betrag lediglich einen Bruchteil dieser Ergebnisse. + Quelle: ElevenMusic Begründet liegt diese signifikante Preisdifferenz in den strikten Nutzungsrechten der neuen Applikation. Sämtliche auf ElevenMusic generierten Werke dürfen die Anwender ausschließlich innerhalb dieses spezifischen Netzwerks veröffentlichen und anhören. Eine externe kommerzielle Nutzung, beispielsweise für Werbekampagnen oder fremden Marken-Content, untersagen die Bedingungen konsequent. Benötigen Produzenten derartige weitreichende Rechte, führt der Weg unweigerlich über das teurere Standardangebot ElevenCreative Music. Anzeige Interaktives Streaming und Vergütung für Künstler Neben der reinen Erstellung positioniert sich die Software als direkter Konkurrent zu etablierten Audio-Diensten. Über 4.000 Künstler stellen ihre Werke dort bereits bereit, welche Hörer direkt in der Anwendung konsumieren. Gefällt ein bestimmter Song, verändern Nutzer über integrierte Tools kurzerhand das Tempo oder verschieben den musikalischen Stil in ein völlig anderes Genre. Ebenso erlaubt die Architektur komplett neue Kompositionen von Grund auf, gesteuert durch präzise Texteingaben oder gewünschte Stimmungen. Erzielte Reichweite wandelt das System schließlich in monetäre Erträge um. Finden die publizierten Eigenkreationen oder Remixe ein entsprechend großes Publikum, erhalten die Schöpfer finanzielle Ausschüttungen. Als Blaupause für diesen Mechanismus dient das Konzept der bestehenden Stimmen-Bibliothek des Unternehmens, über welche bereits über elf Millionen US-Dollar an die Community flossen. Die Webversion sowie die entsprechende iOS-App stehen ab sofort zur Verfügung unter https://elevenmusic.io/ Wer die Musik allerdings überall verwenden möchte, muss die große Plattform nutzen: ANZEIGE