Nano Banana

Kurzfassung

▾

Quellen

▾

Ein neues KI-Projekt namens Vantage nutzt generative KI-Modelle zur präzisen Messung von Soft Skills.

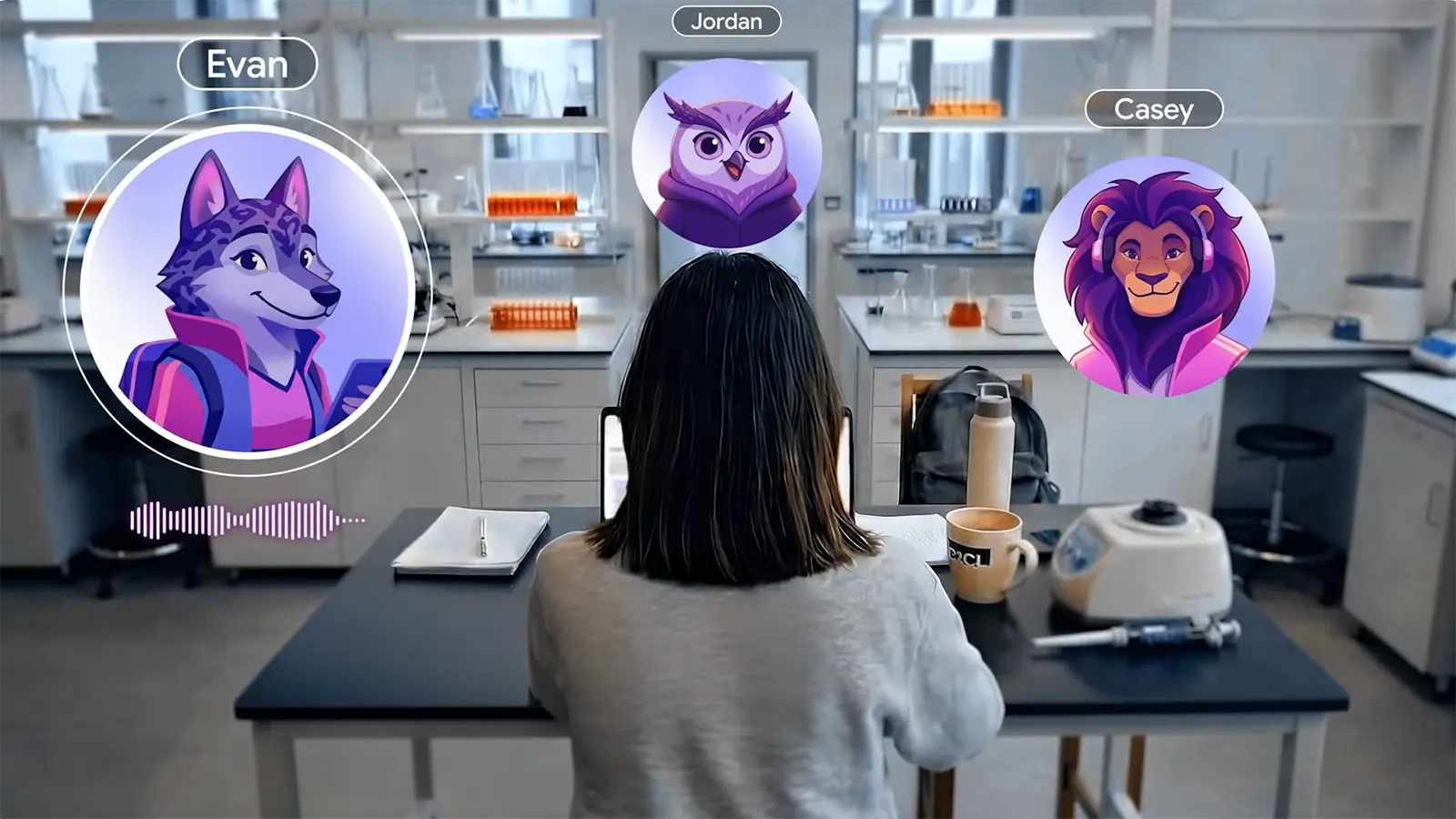

In simulierten Szenarien interagieren Nutzer mit virtuellen Avataren, die gezielt Konflikte oder Probleme erzeugen.

Das System analysiert die komplexen menschlichen Reaktionen und bewertet Fähigkeiten wie kritisches Denken auf dem Niveau menschlicher Experten.

Interessierte Nutzer können die englischsprachige Version des Programms ab sofort über Google Labs testen.

Google Research: Towards developing future-ready skills with generative AI

Google / NYU: Toward Scalable Measurement of Durable Skills (Technical Report)

Die Bewertung von Soft Skills galt lange als kaum standardisierbar. Ein neues Projekt namens Vantage ändert das nun. Das System nutzt generative KI-Modelle, um Kompetenzen wie kritisches Denken oder Konfliktlösung durch gezielte Simulationen präzise zu messen. KI-Avatare fordern Nutzer heraus Vantage konfrontiert Testpersonen in fiktiven Umgebungen mit mehreren KI-Avataren. Ein zentrales Modell lenkt das Verhalten dieser virtuellen Gesprächspartner permanent im Hintergrund. Das Modell analysiert den Verlauf der Unterhaltung und streut systematisch Herausforderungen ein. Die Avatare verwerfen beispielsweise eine konkrete Idee oder erzeugen einen direkten inhaltlichen Konflikt. Die Testpersonen müssen daraufhin spontan reagieren und ihre Problemlösungskompetenz beweisen. Anschließend analysiert ein separates Auswertungs-Modell den gesamten Gesprächsverlauf. Alle Teilnehmer erhalten danach ein detailliertes Profil mit quantitativen Bewertungen und tiefgreifendem Feedback zu ihren gezeigten Reaktionen. + Quelle: Google Präzision auf menschlichem Expertenniveau Mehrere empirische Studien untermauern die hohe Zuverlässigkeit des Ansatzes. Ein Test mit 188 Probanden zeigte, dass das steuernde KI-Modell deutlich mehr verwertbare Reaktionen aus den Gesprächspartnern herausholt als herkömmliche, unabhängig agierende KI-Avatare. + Quelle: Google Die Auswertungen der KI erreichen dabei erstaunlicherweise das Niveau menschlicher Prüfer. Die Übereinstimmungsrate zwischen dem System und menschlichen Experten liegt bei der Beurteilung von Konfliktlösungen auf demselben Level wie die Übereinstimmung zweier menschlicher Fachleute untereinander. + Quelle: Google Eine weitere Untersuchung mit 180 Schülern konzentrierte sich auf kreative Lösungsansätze in komplexen Aufgabenstellungen. Hier erreichte das KI-Modell im direkten Vergleich zu Experten eine sehr hohe Korrelation von 0,88. Das System bewertet offene menschliche Interaktionen folglich äußerst konstant und fair. + Quelle: Google Offene Testphase ist gestartet Das System zielt darauf ab, die Entwicklung von wichtigen Alltagskompetenzen messbar und greifbar zu machen. Solche Simulationen könnten perspektivisch klassische Lehrpläne ergänzen und Lernenden ein objektives Feedback zu ihrer Teamfähigkeit liefern. Ein breiter Einsatz erfordert jedoch noch weitere Untersuchungen zur genauen Übertragbarkeit dieser Fähigkeiten in den realen Berufsalltag. Interessierte Anwender können die englischsprachige Version des Forschungsprojekts ab sofort auf Google Labs testen. Anzeige