TUM Youtube

Kurzfassung

▾

Quellen

▾

Ein Forschungsteam der Technischen Universität München gewann beim Roboter-Halbmarathon in Peking den Preis als bestes internationales Team.

Die Wissenschaftler nutzten für die gestellte Hardwareplattform eine eigene Software, die sie gezielt durch Reinforcement Learning trainierten.

Trotz extremer thermischer Herausforderungen und nur acht Tagen Vorbereitungszeit absolvierte das Modell die 21 Kilometer in rund 3,5 Stunden.

TUM: TUM-Roboter gewinnt „Best International Team Award“

All-AI: Mensch-Roboter-Marathon

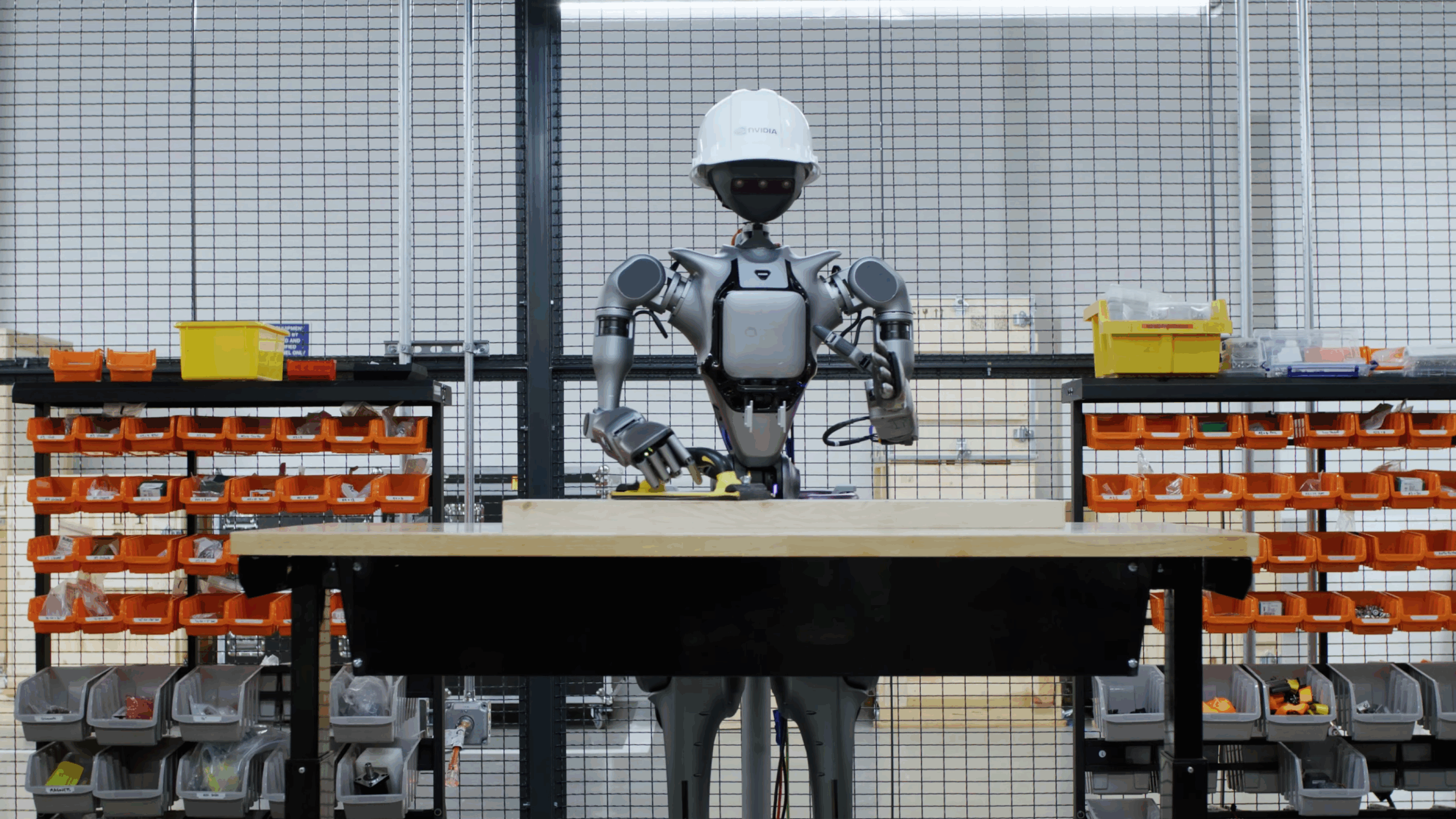

Während ein Laufroboter aus China kürzlich menschliche Bestzeiten beim Halbmarathon unterbot, blieb eine weitere Spitzenleistung fast unbemerkt. Das Team der Technischen Universität München (TUM) gewann in Peking den »Best International Team Award« und stellt das erfolgreichste System außerhalb Chinas. Thermische Limits definieren das Renntempo Etwa die Hälfte der 124 angetretenen Maschinen erreichte beim Wettbewerb über 21 Kilometer nicht die Ziellinie. Laufroboter kämpfen bei solch langen Distanzen primär mit Hardware-Limitierungen. Hohe Geschwindigkeiten treiben den Energieverbrauch in die Höhe und überhitzen rasch die empfindlichen Antriebskomponenten. Die Münchner Forscher entschieden sich daher nach nächtlichen Testläufen für ein konstantes Tempo von zwei Metern pro Sekunde. Diese 7,2 Kilometer pro Stunde garantierten einen sicheren Betrieb der Hardwareplattform Tienkung Ultra. Das System kühlt die Motoren ausschließlich über die vorbeiströmende Luft. Im Gegensatz dazu setzt der spätere Gesamtsieger »Blitz« auf eine aufwendige Wasserkühlung. »Wie man die Hitze ableitet, das ist das Kernthema«, erklärt TUM-Forscher Simon Armleder. Eine effiziente Wärmeabfuhr verschafft individuell gefertigten Maschinen einen enormen Vorteil gegenüber rein luftgekühlten Modellen.

Reinforcement Learning ersetzt Standard-Software Bemerkenswert ist der Ansatz der Universität auf der Softwareseite. Viele andere Forschungsgruppen nutzten den Tienkung Ultra mitsamt den vorinstallierten Steuerungsprogrammen aus dem Innovationszentrum X-Humanoid. Die Gruppe um Professor Gordon Cheng verwarf diesen bequemen Weg komplett. Die Wissenschaftler setzten stattdessen auf ihre jahrelange Erfahrung mit dem System REEM-C von PAL Robotics. Für das Rennen in Peking erstellten sie eine eigene Simulation. Darin trainierten sie die komplexen Bewegungsabläufe der fremden Hardware intensiv mittels Reinforcement Learning. Dieses speziell angepasste Modell steuerte den Roboter im Wettkampf äußerst präzise. Die Vorbereitungszeit fiel dabei extrem knapp aus. Das Team erhielt die Zusage erst zwei Wochen vor dem Startschuss und passte den gesamten Programmcode innerhalb von lediglich acht Tagen an die Maschine an. Anzeige Präzises Monitoring auf der Laufstrecke Während des eigentlichen Laufs verfolgten die Forscher das Modell dicht aus einem Golf-Cart heraus. Sie steuerten das System direkt per Fernbedienung und überwachten essenzielle Telemetriedaten auf einem Smartphone. Das Display zeigte kontinuierlich den aktuellen Batteriestand, die Motortemperaturen sowie die exakte Geschwindigkeit. Ein strenges Regelwerk sanktionierte unplanmäßige Stopps auf der Strecke. Die Münchner wählten deshalb eine äußerst konservative Strategie für die Energieversorgung. Sie tauschten die Akkus dreimal aus, obwohl eine einzige Ladung theoretisch für zehn Kilometer gereicht hätte. Nach 3 Stunden und 35 Minuten überquerte der Roboter schließlich die Ziellinie und belegte den 39. Platz in der Gesamtwertung. Mit mehr Vorlaufzeit planen die Forscher bereits detaillierte Optimierungen für zukünftige Langstreckenläufe.