Adobe

Kurzfassung

▾

Quellen

▾

Adobe integriert KI-Assistenten tief in alle Creative Cloud Apps wie Photoshop und Premiere Pro. Mit Firefly Audio werden neue Werkzeuge zur Generierung von Soundtracks und realistischer Sprache eingeführt. Firefly Image 5 ermöglicht höhere Auflösungen und trainierbare „Custom Models“ für eigene Bildstile. Project Moonlight wurde als übergreifender KI-Agent angekündigt, der als kreativer Direktor app-übergreifend arbeitet.

Adobe Firefly Delivers Groundbreaking AI Audio, Video and Imaging Innovations Adobe Introduces New AI Assistant in Adobe Express that Unlocks Creativity for All Adobe Expands Creative Possibility with AI for Every Creator at Adobe MAX 2025 Adobe Max 2025: all the latest creative tools and AI announcements Adobe Firefly Image 5 brings support for layers, will let creators make custom models

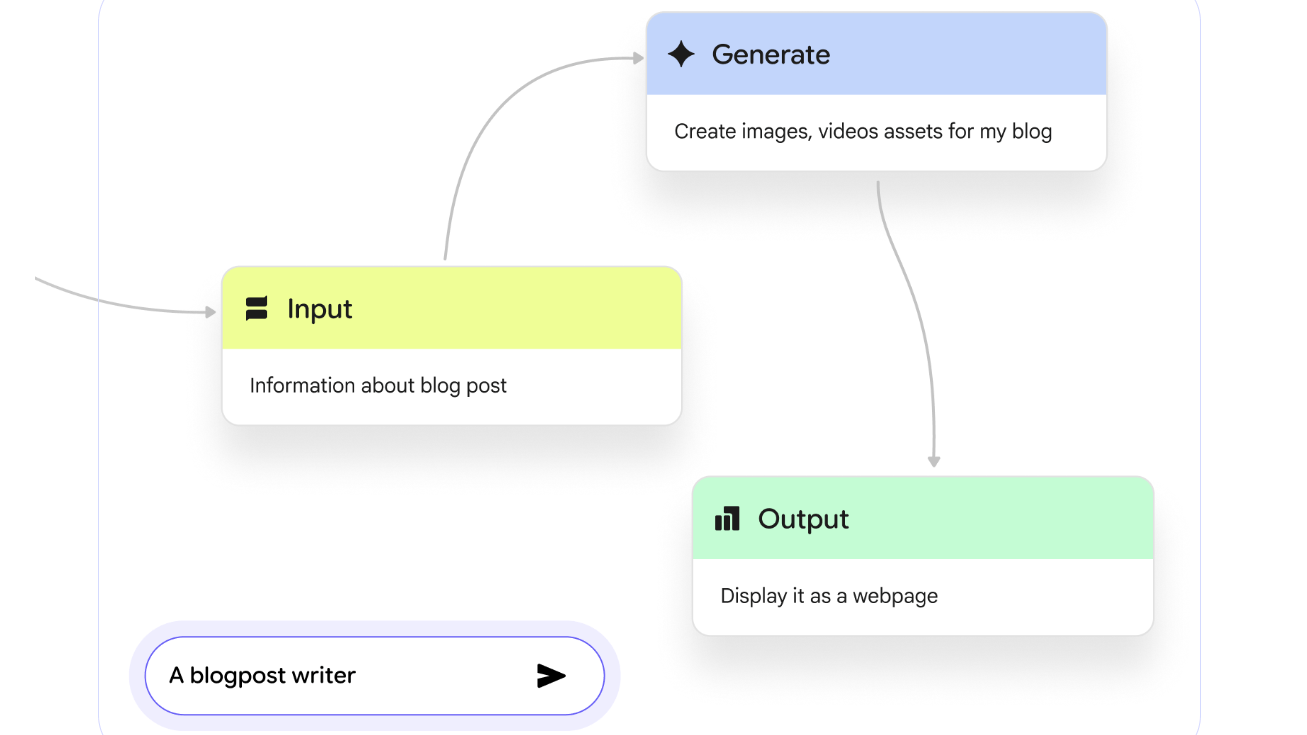

Adobe hat auf seiner MAX 2025 Konferenz eine massive Erweiterung seiner KI-Funktionen vorgestellt. Das Unternehmen integriert KI-Assistenten tief in seine gesamte Creative Cloud. Neue Firefly-Modelle erzeugen Bilder, Ton und Sprache, während ein neuer Agent Arbeitsabläufe über alle Programme hinweg steuern soll. Der Assistent in jeder Werkzeugkiste Adobe bringt KI-Assistenten in alle wichtigen Programme wie Photoshop, Premiere Pro und Illustrator. Diese Helfer sollen Routineaufgaben automatisieren und komplexe Prozesse vereinfachen. Sie arbeiten auch in der Einsteiger-App Adobe Express, um neuen Nutzern den Start zu erleichtern. Nutzer können die Assistenten per Sprache oder Texteingabe steuern. Anstatt Menüs zu durchsuchen oder Werkzeuge mühsam zu kombinieren, sollen Kreative einfach beschreiben, was sie benötigen. Der Assistent greift dann auf die Funktionen der jeweiligen Software zu. Adobe will damit die Einstiegshürde senken und Profis deutlich schneller machen. + Quelle: Adobe Firefly lernt Hören und Sprechen Die größte Neuerung betrifft die Audiobearbeitung. Mit „Firefly Audio“ stellt Adobe erstmals Werkzeuge zur Erzeugung von Musik und Sprache vor. Die Funktion „Generate Soundtrack“ erstellt passende Hintergrundmusik basierend auf einer Beschreibung der gewünschten Stimmung, des Tempos oder der Szene. Parallel dazu kann „Generate Speech“ geschriebenen Text in realistisch klingende Stimmen umwandeln. Gleichzeitig erhält das Bildmodell ein wichtiges Update. Firefly Image 5 liefert Bilder mit höherer nativer Auflösung und einem besseren Verständnis für Details in den Textbefehlen. Es unterstützt zudem die Erstellung eigener, trainierbarer Modelle. Diese „Custom Models“ erlauben es Unternehmen, die KI auf ihren eigenen Stil und ihre Bildsprache zu trainieren. + Quelle: Adobe Project Moonlight als kreativer Direktor Adobe präsentierte auch einen Blick in die Zukunft namens „Project Moonlight“. Dieses System arbeitet als ein übergreifender KI-Agent, der den gesamten kreativen Prozess über mehrere Anwendungen hinweg verstehen und koordinieren soll. Es agiert wie ein digitaler Kreativdirektor. Moonlight könnte beispielsweise ein Konzept aus einer Textdatei nehmen, passende Bilder in Firefly generieren, diese in Photoshop bearbeiten und anschließend in ein Adobe Express-Layout für soziale Medien einfügen. Dieser Ansatz zielt darauf ab, den gesamten Workflow zu automatisieren. Die vorgestellten Werkzeuge zeigen deutlich, wie tief KI künftig den kreativen Alltag bestimmen wird.