The Indian Express (youtube)

Kurzfassung

▾

Quellen

▾

OpenAI-Chef Sam Altman rechnet in wenigen Jahren mit der künstlichen Superintelligenz und warnt eindringlich vor einem unkontrollierbaren Machtmonopol.

Das extrem schnelle Entwicklungstempo der kommenden Modelle übertrifft eigene Prognosen und sorgt branchenintern für unerwartet massiven Stress.

Gleichzeitig arbeitet das Unternehmen mit Ex-Apple-Designer Jony Ive an einer völlig neuen KI-Hardware, die das klassische Smartphone ablösen soll.

Um den gigantischen Energiebedarf der Technologie zu decken, fordert Altman zudem einen raschen und globalen Ausbau von Solar- und Kernkraft.

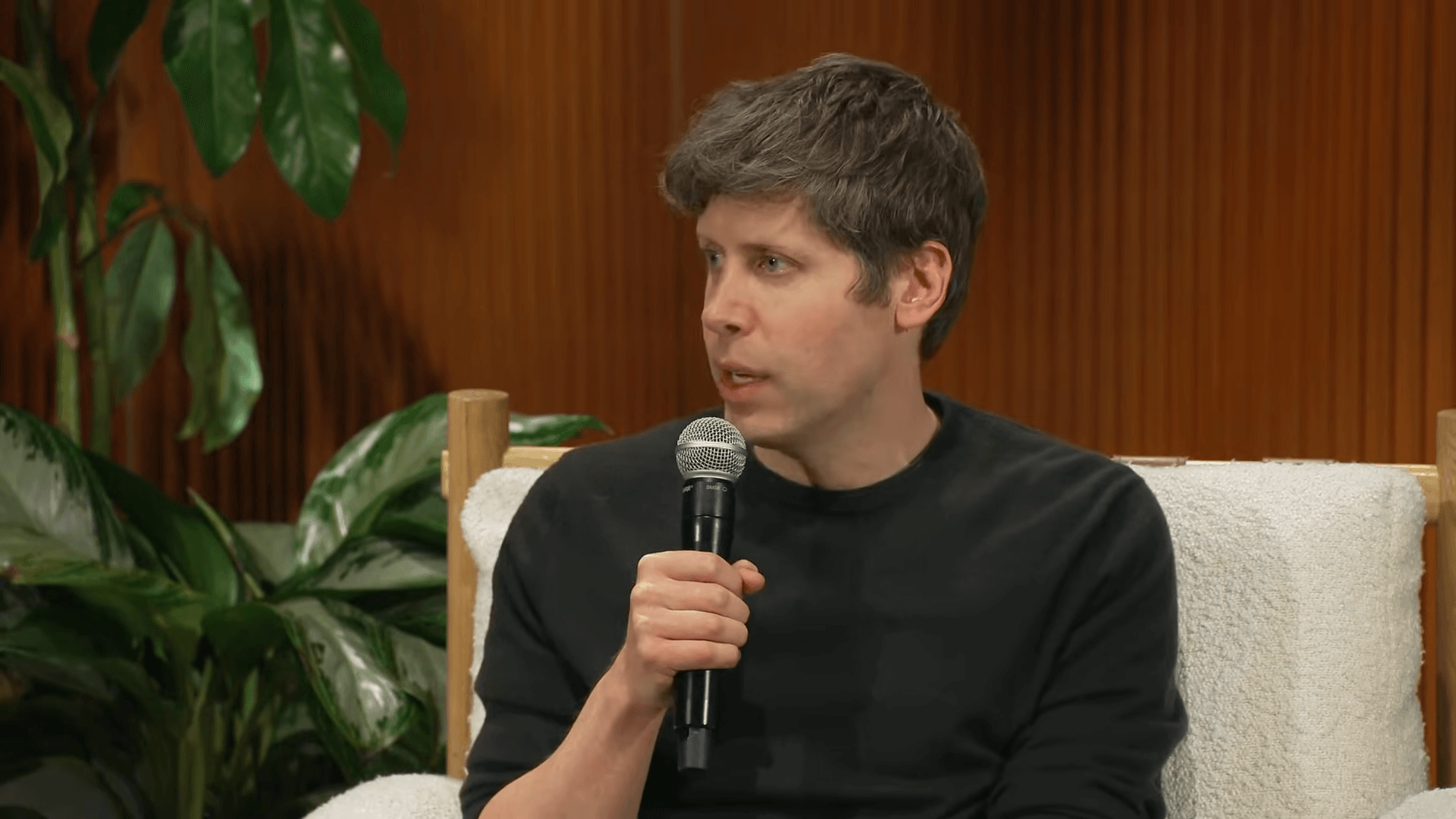

YouTube – Express Adda Interview with Sam Altman

Die Welt ist auf die extrem leistungsfähigen KI-Modelle der nahen Zukunft nicht vorbereitet. In einem aktuellen Interview prognostiziert OpenAI-Chef Sam Altman eine künstliche Superintelligenz in wenigen Jahren und warnt eindringlich davor, diese einer einzelnen Nation zu überlassen. Gleichzeitig kündigt er für Ende 2026 eine eigene Hardware an, die das traditionelle Smartphone ablösen soll.

Ein unvorbereiteter Markt Ein direkter Blick des CEOs hinter die Kulissen der führenden KI-Entwickler offenbart eine wachsende Besorgnis. Der Leistungssprung der kommenden Modelle vollzieht sich laut Altman deutlich schneller, als er selbst ursprünglich prognostizierte. Diese rasante Beschleunigung löst selbst in den Vorstandsetagen Stress und Unbehagen aus, da Gesellschaft und Wirtschaft noch nicht auf die bevorstehenden Veränderungen eingestellt sind. Künstliche allgemeine Intelligenz (AGI) rückt nach seiner Einschätzung in greifbare Nähe, während eine künstliche Superintelligenz (ASI) in nur wenigen Jahren folgen soll. Anzeige Dezentrale Macht statt Monopol Ein einzelnes Land oder Unternehmen darf die Kontrolle über eine derart mächtige Technologie nicht allein besitzen. Altman betont, dass eine starke Konzentration der Rechenleistung enorme Risiken für die globale Stabilität birgt. Stattdessen fordert er, dass die Technologie breitflächig zugänglich sein muss. Nur so lässt sich ein gesundes Gleichgewicht schaffen, welches einen systematischen Machtmissbrauch rechtzeitig verhindert. Abkehr vom klassischen Smartphone Parallel zur reinen Softwareentwicklung bestätigt Altman die Arbeit an einer neuen Gerätekategorie in Zusammenarbeit mit dem Designer Jony Ive. Die grundlegende Bedienung von Computern hat sich seit 50 Jahren kaum verändert und verlässt sich weiterhin auf Bildschirme sowie starre Eingabeformen. Fortschrittliche KI-Modelle verlangen jedoch nach völlig neuen Interaktionswegen. Ein System, das den Lebenskontext des Nutzers vollständig versteht und permanent über natürliche Sprache agiert, passt laut dem OpenAI-Chef nicht in das bekannte Format eines Telefons. Erste Details zu dieser Hardware plant das Unternehmen noch Ende dieses Jahres vorzustellen. Die Konstruktion solcher nativen KI-Geräte erweist sich in der Praxis allerdings als äußerst komplex. Anzeige Energiebedarf und Weltraum-Pläne Das Training und der laufende Betrieb dieser Architekturen verschlingen immense Mengen an Rechenleistung. Berichte über einen extremen Wasserverbrauch pro einzelner Suchanfrage weist Altman in dem Gespräch strikt als falsch zurück, da moderne Rechenzentren längst keine Verdunstungskühlung mehr einsetzen. Der tatsächliche physikalische Engpass liegt beim massiven Gesamtstrombedarf der Branche. Um diesen kontinuierlich steigenden Hunger zu decken, ist ein schneller Ausbau von Solarenergie und Kernkraft zwingend notwendig. Visionären Ideen, gigantische Rechenzentren künftig einfach in den Weltraum auszulagern, erteilt er für das laufende Jahrzehnt eine klare Absage. Die enormen Transportkosten in den Orbit übersteigen den thermischen und energetischen Nutzen auf der Erde um ein Vielfaches.

Top News

Musk prognostiziert günstigere KI-Rechenzentren im Weltraum in drei Jahren

Die fehlende Atmosphäre macht Kühlung schwer, doch billige Raketenstarts ermöglichen tonnenschwere Lösungen gegen die Überhitzung.

Spürbare Konkurrenz in der Branche Wie hart der Wettbewerb im KI-Sektor hinter den Kulissen ist, zeigte sich zuletzt auch bei öffentlichen Auftritten. Bei einem gemeinsamen Fototermin mieden Sam Altman und die Führungskräfte des direkten Konkurrenten Anthropic auffällig jeden physischen Kontakt. + Quelle: ANI News Dieser Vorfall unterstreicht die angespannte Stimmung zwischen den Entwicklungsunternehmen. Neben der reinen technologischen Leistung entscheidet zunehmend auch der direkte Kampf um Investorengelder und Marktanteile über die zukünftige Ausrichtung der Branche. Anzeige