Nano Banana

Kurzfassung

▾

Quellen

▾

Runway hat in einer Series-E-Finanzierungsrunde 315 Millionen US-Dollar eingesammelt. Die Unternehmensbewertung steigt durch das frische Kapital auf 5,3 Milliarden US-Dollar. Der Fokus liegt auf der Entwicklung von „World Models“, die physikalische Zusammenhänge simulieren. Zu den Investoren gehören neben General Atlantic auch Nvidia, AMD und Adobe.

Runway – New Funding to Scale World Simulation

TechCrunch – AI video startup Runway raises $315M

Bloomberg – AI Video Startup Runway Valued at $5.3 Billion

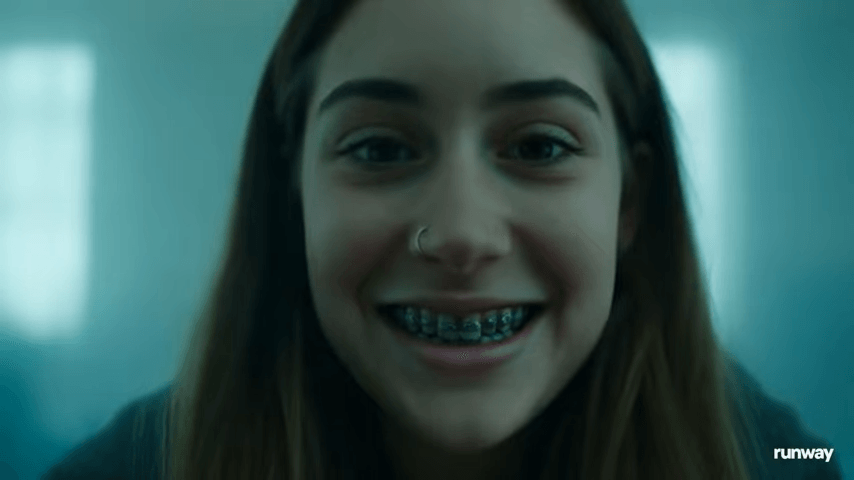

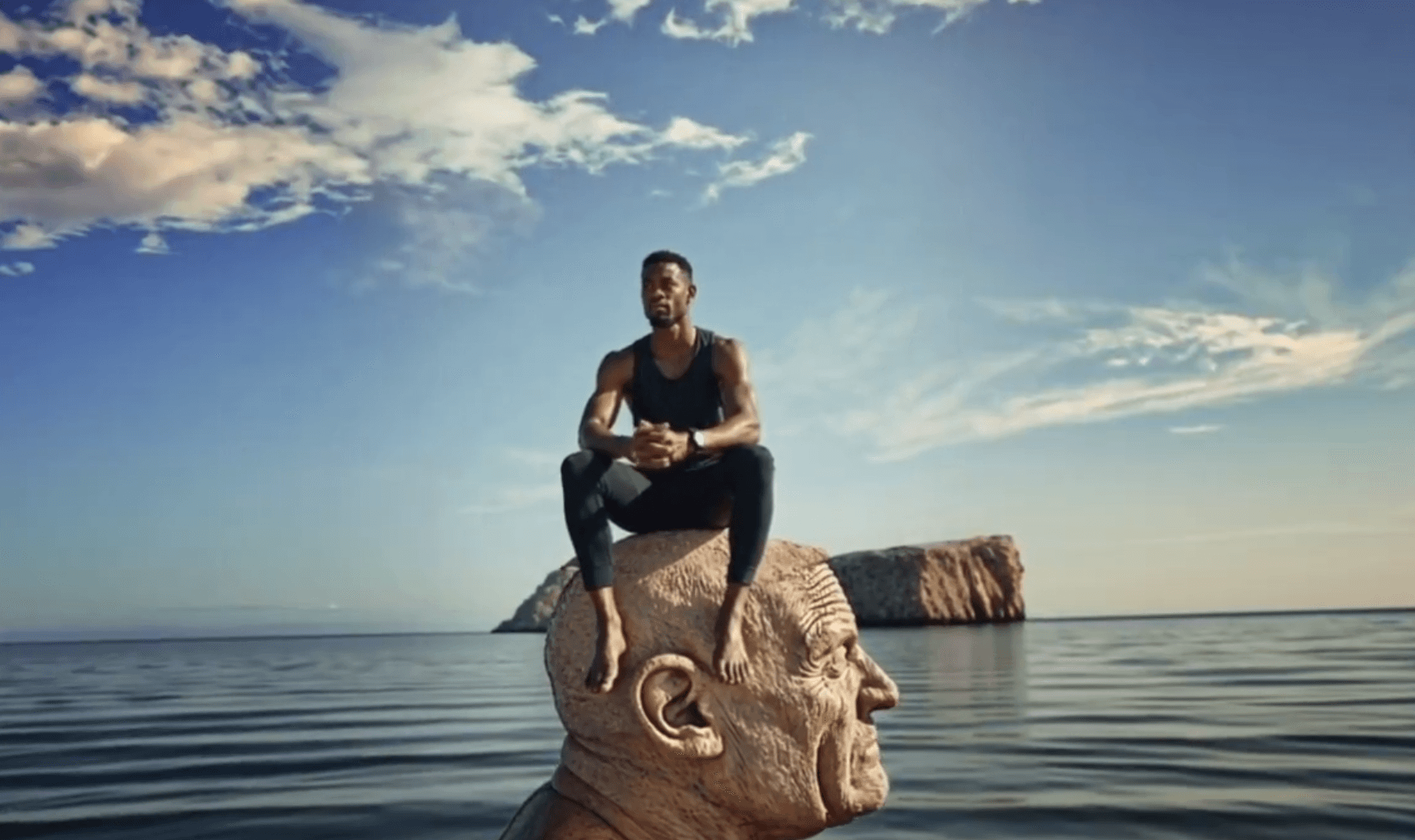

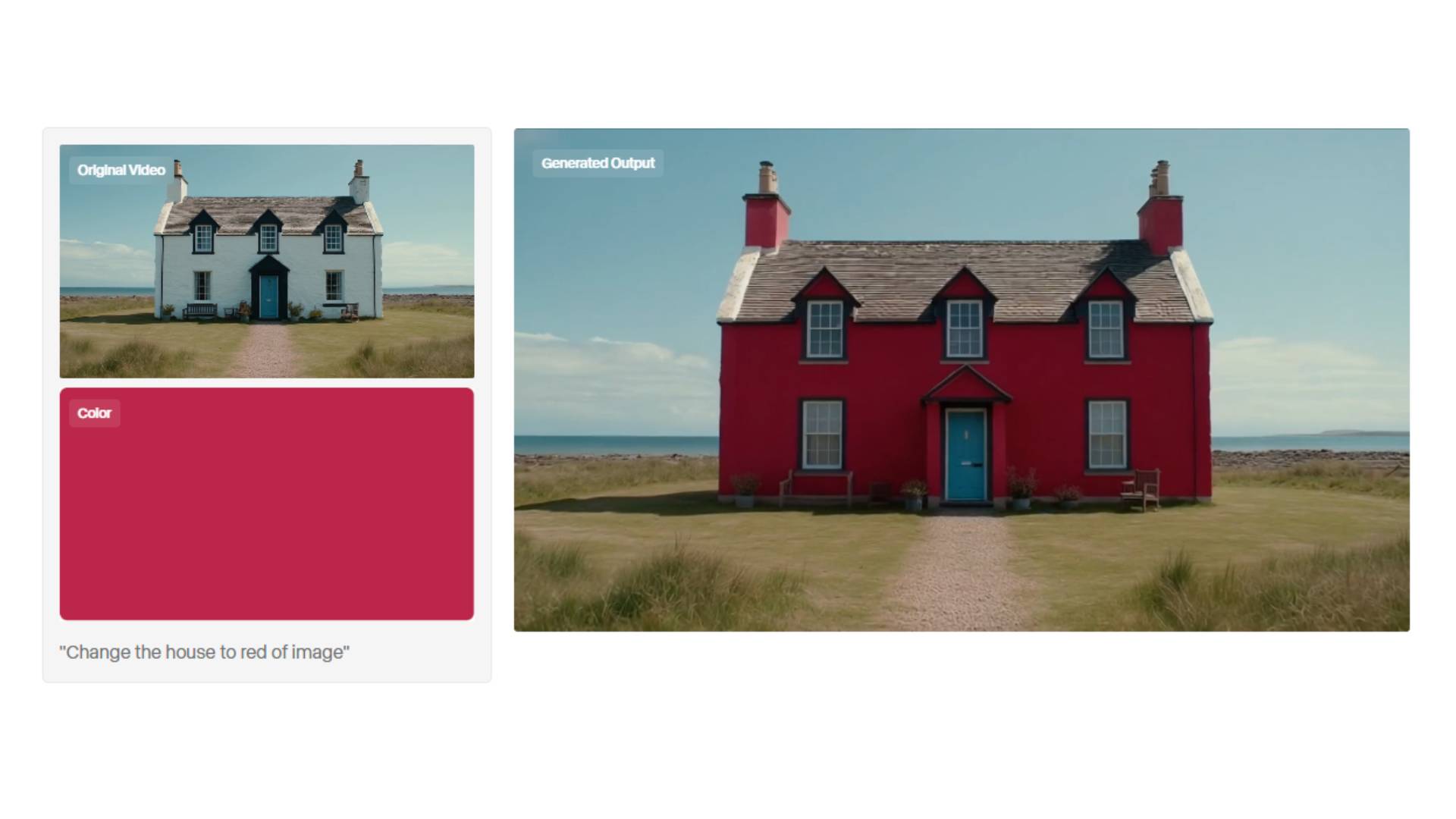

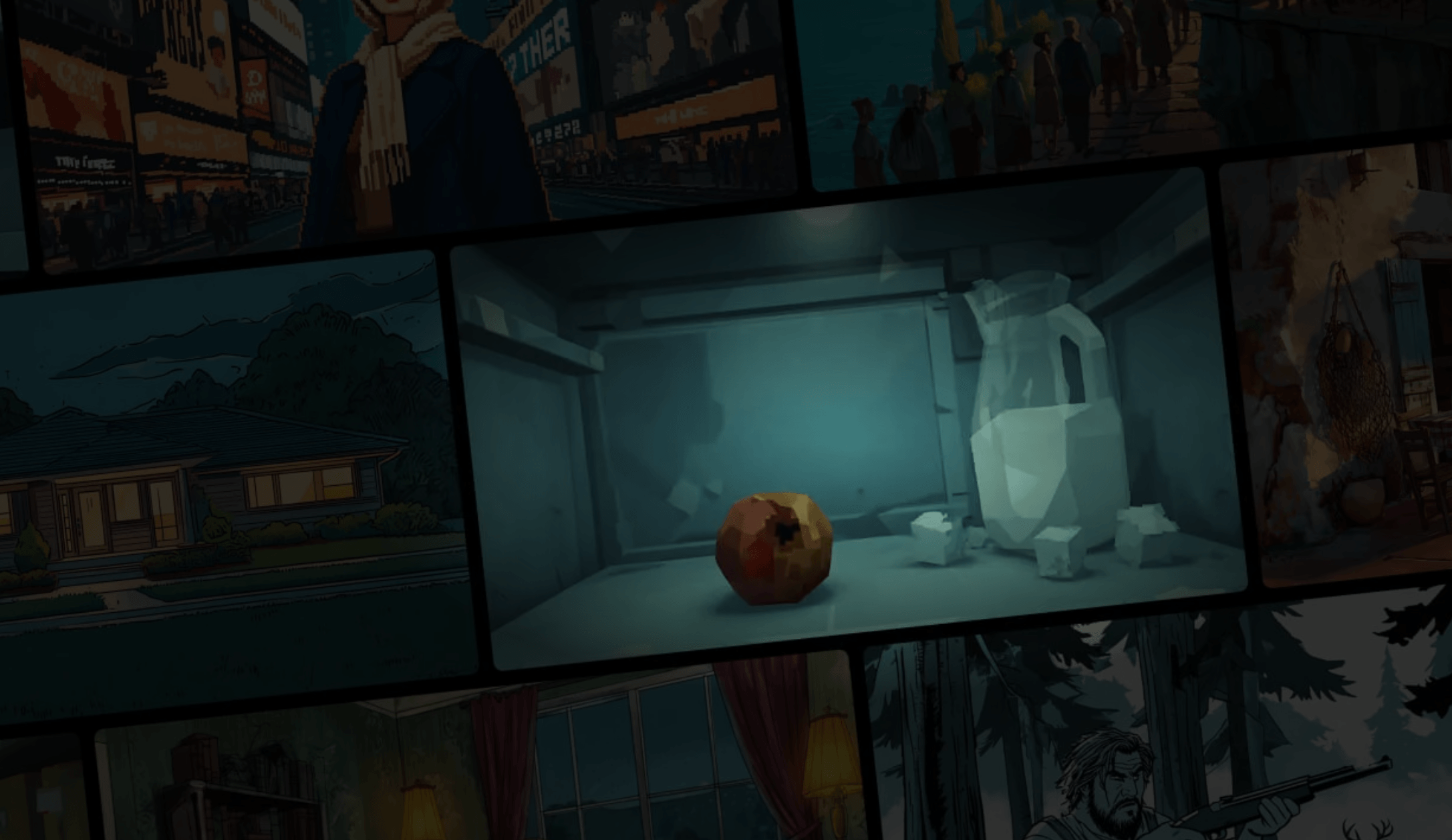

Das KI-Startup Runway sichert sich in einer Series-E-Finanzierungsrunde frisches Kapital und steigert seine Bewertung auf 5,3 Milliarden US-Dollar. Der Fokus verschiebt sich dabei technologisch: Weg von reiner Videogenerierung, hin zu sogenannten „World Models“, die physikalische Zusammenhänge verstehen sollen. Am heutigen Dienstag gab Runway bekannt, dass es 315 Millionen US-Dollar (ca. 290 Millionen Euro) eingesammelt hat. Die Finanzierungsrunde wird erneut vom Private-Equity-Unternehmen General Atlantic angeführt. Mit dem frischen Kapital steigt die Bewertung des New Yorker Unternehmens auf 5,3 Milliarden US-Dollar. Zum Vergleich: Noch im April 2025 lag der Firmenwert bei einer Runde über 308 Millionen Dollar bei rund 3 Milliarden Dollar. Prominente Hardware-Partner an Bord Die Liste der Co-Investoren liest sich wie ein Verzeichnis der aktuellen Hardware- und Software-Elite. Neben General Atlantic beteiligen sich unter anderem Nvidia, AMD Ventures und Adobe Ventures. Insbesondere die Präsenz von Nvidia und AMD verdeutlicht den enormen Rechenbedarf, den Runway für seine kommenden Modelle veranschlagt. Dass Adobe erneut investiert, deutet auf eine weitere Integration der Technologie in kreative Workflows hin. Laut CEO Cristóbal Valenzuela sollen die Mittel primär dazu dienen, die nächste Generation der „World Models“ zu trainieren und die dafür nötige Infrastruktur auszubauen. Das Unternehmen plant zudem, sein Personal in den Bereichen Forschung und Engineering aufzustocken. Anzeige Vom Pixel zur Physik: Was sind „World Models“? Technisch markiert dieser Schritt eine Evolution der generativen KI. Während bisherige Text-zu-Video-Modelle (wie das im Dezember 2025 veröffentlichte Gen-4.5) darauf trainiert waren, Pixelwahrscheinlichkeiten vorherzusagen, um ästhetisch ansprechende Videos zu erzeugen, gehen „General World Models“ (GWM) einen Schritt weiter. Ein Weltmodell versucht, eine interne Repräsentation der physischen Umgebung aufzubauen. Es soll nicht nur wissen, wie eine fallende Tasse aussieht, sondern verstehen, dass sie aufgrund der Schwerkraft fällt und beim Aufprall zerspringt. Das Ziel ist eine Simulation von Kausalität und räumlichen Beziehungen. Runway hatte bereits Ende 2025 erste Versionen (GWM-Worlds und GWM-Robotics) vorgestellt. Die Relevanz dieser Technologie reicht über die Filmindustrie hinaus: Solche Simulatoren sind essenziell für das Training von Robotern oder autonomen Systemen, die in einer sicheren, virtuellen Umgebung lernen müssen, bevor sie in der Realität agieren. Teurer Wettlauf gegen Tech-Giganten Der Vorstoß in Richtung Weltmodelle ist kein Alleingang. Runway konkurriert hier direkt mit Schwergewichten wie Google DeepMind, OpenAI (Sora) und dem von Fei-Fei Li gegründeten Startup World Labs. Diese Systeme verschlingen enorme Rechenkapazitäten, was die hohen Investitionssummen erklärt. In der Praxis muss sich allerdings noch zeigen, wie robust diese Simulationen außerhalb von kontrollierten Demos funktionieren. Bisherige generative Modelle halluzinieren häufig physikalische Gesetzmäßigkeiten – Objekte verschwinden oder bewegen sich unnatürlich. Ob die neuen GWM-Ansätze diese fundamentalen Probleme lösen und verlässliche Simulationen für die Industrie liefern können, bleibt abzuwarten. Das frische Kapital erkauft Runway zumindest die Zeit und die Rechenleistung, um diesen Beweis anzutreten.