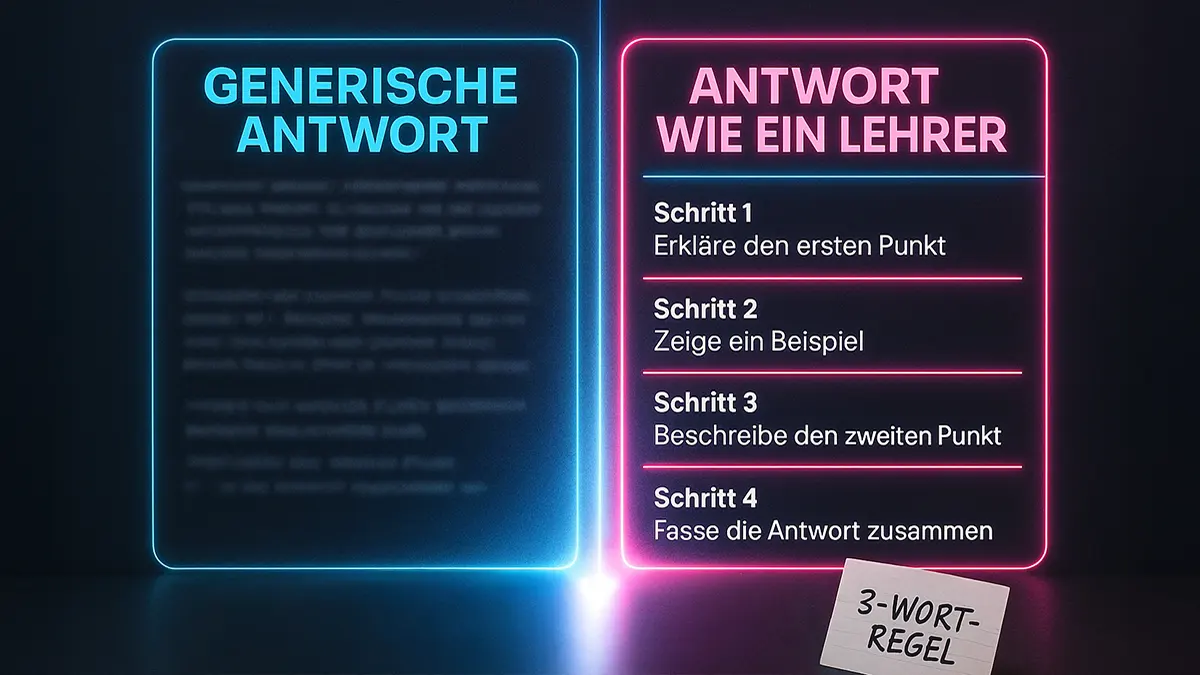

GPT-5 bändigen: Drei Worte, die alles ändern! Rolle, Ziel, Format – mehr braucht es nicht. So verwandelt sich ChatGPT in Lehrer, PM oder Recruiter und liefert starke Antworten statt generischer Textblöcke. Kurzfassung | Andreas Becker, 05.09.25

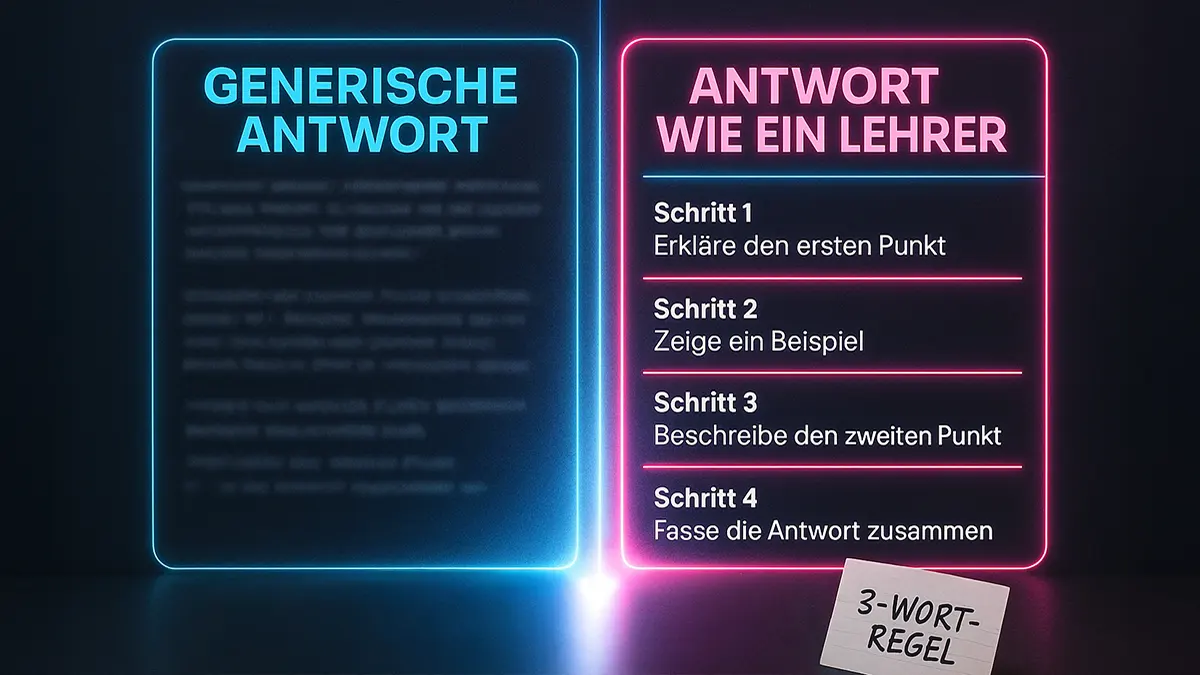

gpt-image-1 | All-AI.de EINLEITUNG Oft liefert ChatGPT genau das, was keiner braucht: vage Tipps, die klingen wie eine Wikipedia-Zusammenfassung mit freundlichem Tonfall. Doch ein kleiner Trick bringt echte Hilfe. Wer seinem Prompt drei einfache Worte hinzufügt – etwa „wie ein Lehrer“ – bekommt auf einmal strukturierte, verständliche und überraschend nützliche Antworten. Die Methode nennt sich 3-Wort-Regel. Hier steht, wie sie funktioniert – und warum sie so gut wirkt. ANLEITUNG Was steckt hinter der 3-Wort-Regel? Im Kern ist die Idee simpel: Statt bloß zu fragen, ergänzt man den Prompt mit einer Rolle. Das verändert alles. Ein Lehrer erklärt anders als ein Coach. Ein Jurist achtet auf Risiken, ein Recruiter auf Wirkung. ChatGPT orientiert sich bei seinen Antworten genau daran. Die drei Worte „wie ein Coach“ oder „als Jurist“ geben dem System eine Richtung – Ton, Struktur und Prioritäten passen sich automatisch an. Diese Methode funktioniert so gut, weil große Sprachmodelle stark auf Kontext reagieren. Die Rolle wirkt wie ein Filter. Die Antwort ist plötzlich keine allgemeine Info mehr, sondern zugeschnitten auf die Aufgabe, die Person – oder beides. + Was Rollen ändern – und was nicht Die Rolle hilft dem Modell, das Format zu wählen: Schritt-für-Schritt oder klar gegliedert, empathisch oder sachlich, motivierend oder warnend. Statt Floskeln gibt es Struktur. Statt Vorschläge gibt es Pläne. Aber wichtig: Die Rolle macht die Antwort nicht automatisch richtiger. Wenn ein Prompt Faktenwissen verlangt, sollte man zusätzlich nach Quellen fragen oder darum bitten, Unsicherheiten offenzulegen. Die Rolle verbessert Stil und Nutzbarkeit – nicht zwangsläufig die Wahrheit. Wie man mit drei Worten mehr herausholt Die Grundformel lautet: Inhalt + Rolle. Ergänzend wird es noch besser mit einem zweiten Satz. Also zum Beispiel: „Erkläre ChatGPT-Grundlagen wie ein Lehrer.“ + „In fünf Lektionen, jeweils mit Beispiel und Übung.“ „Plane meine Woche wie ein Projektmanager.“ + „Mit Deadlines, realistischen Zielen und wenig Aufwand.“ So entsteht ein präziser Auftrag, bei dem ChatGPT genau weiß, was erwartet wird – und in welcher Form. Wann das richtig gut funktioniert Am besten wirkt die Regel, wenn man eine klare Aufgabe hat – also nicht bloß „Was ist XY?“, sondern „Hilf mir dabei…“. Wer zum Beispiel einen 10KM-Lauf plant, fragt: „Erstelle mir einen Trainingsplan wie ein Coach, mit Wochenstruktur, Motivationstipps und Anpassung für Anfänger.“ Beim Lernen hilft: „Erkläre das Konzept des Bierbrauens wie ein Lehrer, einfach, anschaulich und mit Vergleich aus dem Alltag.“ Sogar Verträge lassen sich so besser verstehen: „Fasse diesen Vertrag wie ein Jurist zusammen, klar und mit Hinweisen auf Risiken.“ Auch Lebensläufe, Projektpläne oder Ernährungstipps gewinnen enorm, wenn die Rolle stimmt. Immer dann, wenn es nicht nur um Fakten, sondern um Umsetzung, Bewertung oder Struktur geht. Wo Vorsicht angebracht ist Wer eine juristische oder medizinische Rolle vorgibt, sollte wissen: Das Modell spielt diese Rolle nur. Es simuliert Fachlichkeit, ersetzt aber keine echte Expertise. Daher immer als Orientierung nutzen, nicht als alleinige Entscheidungsgrundlage. Auch emotional sensible Rollen – etwa „wie ein Therapeut“ – funktionieren stilistisch sehr gut, können aber kritische Themen nicht auffangen. Hier gilt: Bei ernsten Problemen echte Menschen fragen. Drei Templates für den Alltag

Prompt Lehrer

Copy

Erkläre [Thema] wie ein Lehrer, in fünf klaren Abschnitten mit je einem Beispiel.

Projektmanager

Copy

Strukturiere meine Woche wie ein Projektmanager, mit drei To-dos pro Tag und realistischen Deadlines.

Prompt Recruiter

Copy

Überarbeite meinen Lebenslauf wie ein Recruiter, mit Fokus auf messbaren Erfolgen und Keywords aus der Branche.

Diese Vorlagen lassen sich beliebig anpassen – je nach Rolle und Ziel. Und sie funktionieren sofort, auch auf Deutsch. Kurzcheck vorm Absenden Bevor man den Prompt losschickt, hilft ein Blick auf drei Punkte: Ist die Rolle klar und sinnvoll gewählt? Ist das Ziel der Antwort beschrieben (lernen, planen, verbessern) Ist das gewünschte Format oder der Umfang genannt? Mit diesen Zutaten liefert ChatGPT-5 keine Worthülsen mehr, sondern Antworten, die man wirklich brauchen kann. DEIN VORTEIL – DEINE HILFE Kostenlose News und Tutorials – mit minimaler Werbung und maximalem Mehrwert. Damit das so bleibt und wir uns stetig verbessern können, freuen wir uns über deine Unterstützung. Teile diesen Beitrag Folge uns auf Social Media Keine KI-News mehr verpassen und direkt kommentieren! Mastodon X Bluesky Facebook LinkedIn Youtube Unterstütze uns direkt Mit einer YouTube-Mitgliedschaft (ab 0,99 €) oder einmalig über PayPal. So helft ihr uns, unabhängig neue Tools zu testen und noch mehr Tutorials für euch zu erstellen. Vielen Dank für euren Support! Youtube – Kanal PayPal – Kaffee KURZFASSUNG Die 3-Wort-Regel setzt ChatGPT-5 eine Rolle und liefert damit strukturiertere, nützlichere Antworten. Rolle + Ziel + Format sind die Kurzformel; Beispiele und Constraints erhöhen die Steuerbarkeit deutlich. Für faktische Korrektheit bleiben Quellen, Verifikation und klare Grenzen wichtig. Mit wenigen Templates lässt sich die Regel sofort in Lernen, Projekte und Karriere umsetzen. QUELLEN Tom’s Guide – 3-Wort-Regel mit ChatGPT-5 OpenAI Cookbook – GPT-5 Prompting Guide OpenAI Help – Prompt-Engineering-Best-Practices Anthropic Docs – Prompt Engineering Overview Learn Prompting (DE) – Rollen-Prompting