Nano Banana

Kurzfassung

▾

Quellen

▾

Ein neues industriepolitisches Konzept skizziert Maßnahmen für den Übergang in das Zeitalter der Superintelligenz.

Zentrale Forderungen umfassen einen öffentlichen Vermögensfonds, eine 32-Stunden-Woche bei vollem Lohnausgleich und ein grundlegendes Recht auf KI-Zugang.

Um den Wandel abzusichern, verlangt das Papier zudem neue Steuerkonzepte, strikte Audits für hochriskante Modelle und verbindliche Notfallpläne.

Begleitet wird der Vorstoß von einem neuen Förderprogramm in Washington, das Forschern Stipendien und API-Guthaben in Millionenhöhe bietet.

OpenAI: Industrial policy for the Intelligence Age

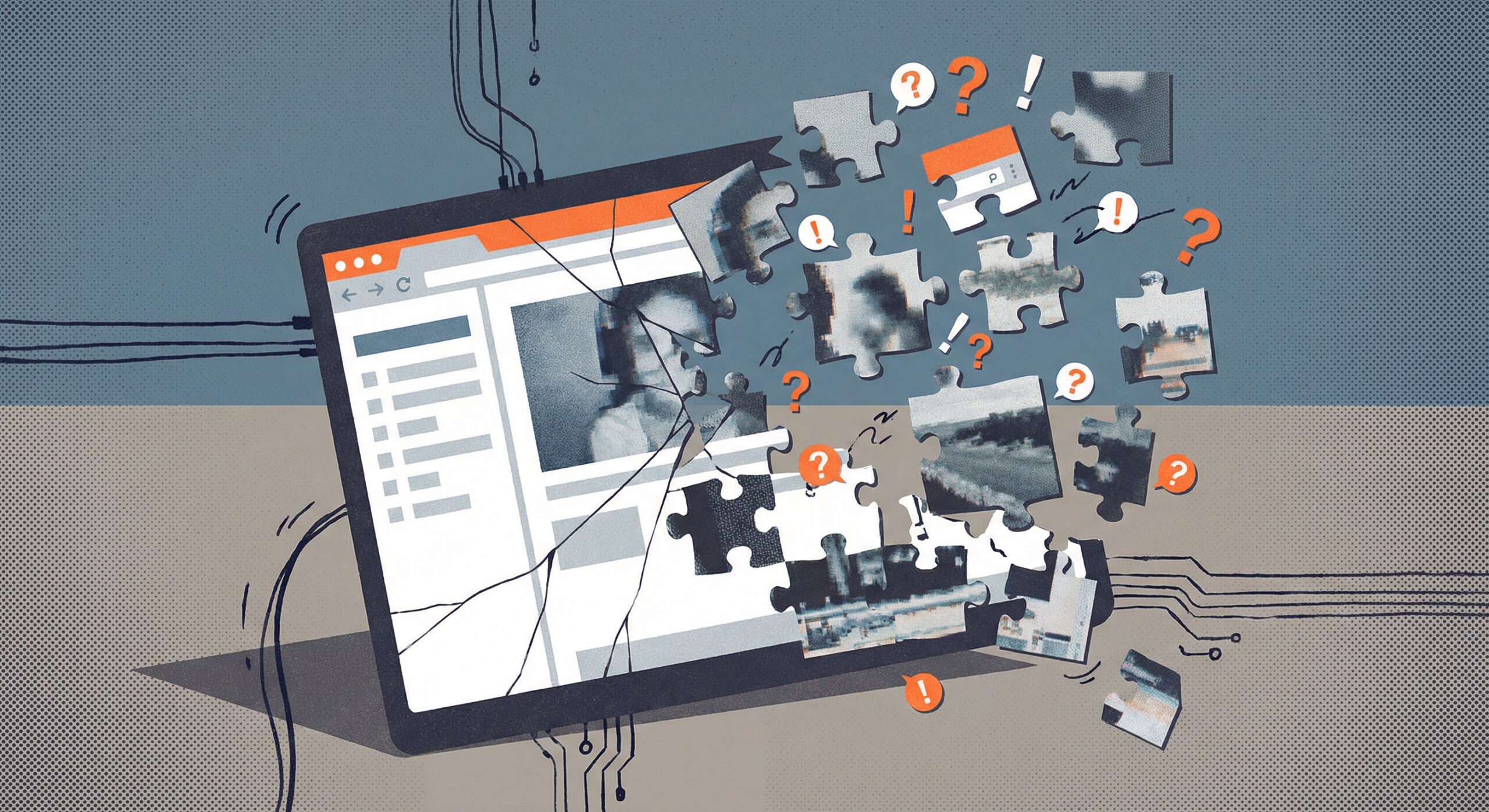

Die Entwicklung in Richtung Superintelligenz verlangt tiefgreifende wirtschaftliche Eingriffe. Ein neues industriepolitisches Konzept von OpenAI skizziert nun weitreichende Maßnahmen, darunter einen öffentlichen Vermögensfonds, die 32-Stunden-Woche und ein universelles »Recht auf KI«. Neuverteilung des Reichtums Der Zugang zu leistungsstarken Modellen gilt in dem Entwurf als essenzielle Infrastruktur. Ähnlich wie Strom oder das Internet erfordert die Technologie eine garantierte Basisversorgung für alle gesellschaftlichen Schichten. Um die finanziellen Gewinne der Automatisierung gerecht zu verteilen, steht die Gründung eines Public Wealth Fund im Fokus. Dieser Fonds investiert breit in den KI-Sektor. Die Erträge fließen anschließend als direkte Auszahlung an die Bevölkerung. So partizipieren auch Menschen ohne eigenes Startkapital am wirtschaftlichen Aufschwung der Technologie. Anzeige Steuern und Arbeitszeit Die technologische Entwicklung erzwingt gleichzeitig einen Umbau des traditionellen Steuersystems. Wenn der Faktor der menschlichen Arbeit schrumpft, brechen wichtige Einnahmen für die Sozialsysteme weg. Als Ausgleich sieht der Plan vor, vermehrt Kapitalerträge, Unternehmensgewinne und speziell automatisierte Arbeit zu besteuern. Die daraus resultierenden betrieblichen Effizienzgewinne sollen den Angestellten zugutekommen. Das Konzept schlägt konkrete Pilotprojekte für eine 32-Stunden-Woche bei vollem Lohnausgleich vor. Sicherheit und Infrastruktur Der immense Energiebedarf aktueller und kommender Modelle verlangt einen extrem schnellen Ausbau der Stromnetze. Öffentlich-private Partnerschaften übernehmen hierbei idealerweise die Finanzierung und reduzieren bürokratische Hürden. Auf technischer Ebene fordert das Positionspapier strikte Audits. Hochriskante KI-Systeme erfordern unabhängige Vor- und Nachkontrollen durch Einrichtungen wie das Center for AI Standards and Innovation (CAISI). Gleichzeitig müssen fertige Notfallpläne in den Schubladen liegen. Diese greifen ein, falls gefährliche Modelle in die freie Wildbahn gelangen und die Entwickler den Zugriff verlieren. Anzeige Millionen-Förderung für Forscher Die Theorie geht nun den ersten Schritt in Richtung Praxis. Im Mai öffnet dafür ein neuer Workshop in Washington, D.C. seine Türen. Forscher und Entwickler, die auf diesen politischen Ideen aufbauen, erhalten erhebliche finanzielle Unterstützung. Das begleitende Pilotprogramm umfasst Forschungsstipendien von bis zu 100.000 US-Dollar sowie API-Guthaben im Wert von einer Million US-Dollar, die Interessierte ab sofort beantragen können.