TUM/Astrid Eckert

Kurzfassung

▾

Quellen

▾

Ein ab dem Hals gelähmter Patient testet derzeit an der TU München ein neuartiges Brain-Computer-Interface.

Über 256 direkt implantierte Mikroelektroden erfassen präzise die Hirnaktivität bei vorgestellten Bewegungen.

Spezielle KI-Modelle decodieren diese neuronalen Muster, um in Zukunft einen mechanischen Roboterarm zu steuern.

Das System soll Betroffenen langfristig wieder eigenständiges Essen und Trinken ermöglichen.

TUM – Hirn-Computer-Schnittstelle: Mit der Kraft der Gedanken

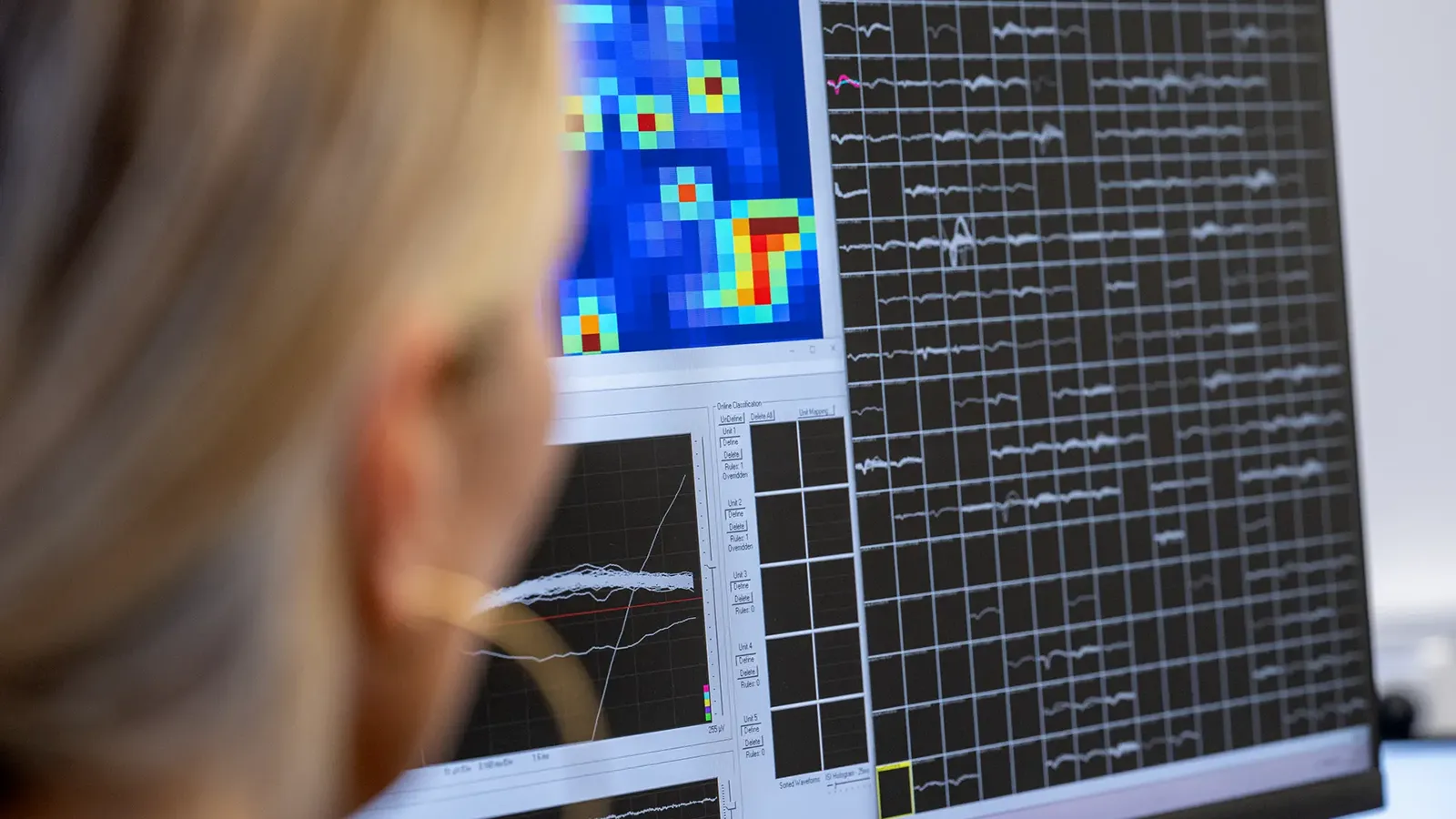

Gelähmte Menschen könnten künftig allein durch die Kraft ihrer Gedanken mit der physischen Welt interagieren. Münchner Forscher nutzen aktuell ein fortschrittliches Brain-Computer-Interface, das neuronale Signale mithilfe leistungsstarker KI-Modelle in konkrete Bewegungsbefehle für externe Geräte übersetzt. Direkte Verbindung zum Gehirn Im vergangenen Jahr erhielt der vom Hals abwärts gelähmte Patient Michael Mehringer ein hochmodernes Implantat. Während einer mehrstündigen Operation setzten Chirurgen vier winzige Elektroden-Arrays direkt in sein Gehirn ein. Jedes dieser feinen Quadrate trägt 64 nadelförmige Mikroelektroden auf seiner Oberfläche. Insgesamt erfassen somit 256 Sensoren die Hirnaktivität exakt in den Regionen, in denen der Mensch komplexe Bewegungsabläufe plant. Ein derart präziser mikroelektrodenbasierter Eingriff bei einer Querschnittslähmung fand damit zum ersten Mal in Europa statt. Feine Kabel leiten die kontinuierlich gemessenen Datenfolgen an einen externen Rechner weiter. Dort erscheint die Hirnaktivität als farbiges, ständig in Bewegung befindliches Raster auf dem Monitor. Jedes farbliche Aufleuchten in dem Gittergewebe markiert dabei ein spezifisches neuronales Muster. Anzeige KI-Modelle erkennen Intentionen Aktuell absolviert der Patient zweimal pro Woche ein intensives Training mit einem virtuellen Arm auf dem Bildschirm. Stellt Mehringer sich das Strecken seiner Gelenke vor, verarbeiten speziell abgestimmte KI-Modelle die eintreffenden neurologischen Daten. Diese werten das komplexe Aktivitätsmuster aus und entschlüsseln die genaue Bewegungsabsicht in Sekundenbruchteilen. Das interdisziplinäre Forschungsteam aus Neurobiologie und Robotik verfolgt bei der Entwicklung einen strikt nutzerzentrierten Ansatz. Anstatt den Menschen an eine komplizierte mechanische Steuerung zu gewöhnen, sollen die trainierten KI-Modelle die Intentionen des Patienten von Beginn an völlig selbstständig interpretieren. Zunächst bewegt der Proband auf diese Weise lediglich einen digitalen Cursor zielgerichtet über das Display. Der Schritt in die physische Welt Auf lange Sicht zielt das ehrgeizige Projekt jedoch auf die Steuerung echter Hardware ab. Nach einem erfolgreichen Training am Computer soll ein mechanischer Greifarm die decodierten Befehle reibungslos in der realen Welt ausführen. Dadurch könnte der junge Patient in Zukunft vielleicht wieder eigenständig nach einem Wasserglas greifen oder selbstständig Nahrung aufnehmen. Natürlich befindet sich das gesamte Vorhaben noch tief in der Forschungsphase und bietet keine unmittelbare klinische Heilung für geschädigte Nervensysteme. Dennoch unterstreichen die bisherigen Testläufe das enorme Potenzial der vernetzten Technologie. Das enge Zusammenspiel aus Neurochirurgie und künstlicher Intelligenz ebnet Betroffenen einen sehr realistischen Weg zu spürbar mehr Autonomie im Alltag.