GitHub rechnet Copilot ab dem 1. Juni 2026 nach tatsächlichem Verbrauch ab.

Der Artikel GitHub bittet Copilot-Vielnutzer ab Juni stärker zur Kasse erschien zuerst auf The Decoder.

GitHub rechnet Copilot ab dem 1. Juni 2026 nach tatsächlichem Verbrauch ab.

Der Artikel GitHub bittet Copilot-Vielnutzer ab Juni stärker zur Kasse erschien zuerst auf The Decoder.

GitHub ändert ab dem 24. April 2026 seine Datenrichtlinie für Copilot. Interaktionsdaten von Nutzern der Tarife Free, Pro und Pro+ werden künftig zum Training von KI-Modellen verwendet, sofern diese nicht aktiv widersprechen.

Der Artikel GitHub Copilot nutzt ab April Nutzerdaten für KI-Training erschien zuerst auf The Decoder.

OpenAI arbeitet laut The Information an einer eigenen Alternative zu GitHub, Microsofts weit verbreiteter Plattform für Code-Verwaltung und Zusammenarbeit.

Der Artikel OpenAI baut eigene Code-Plattform als Alternative zu Microsofts GitHub erschien zuerst auf The Decoder.

Nano Banana

Kurzfassung

▾

Quellen

▾

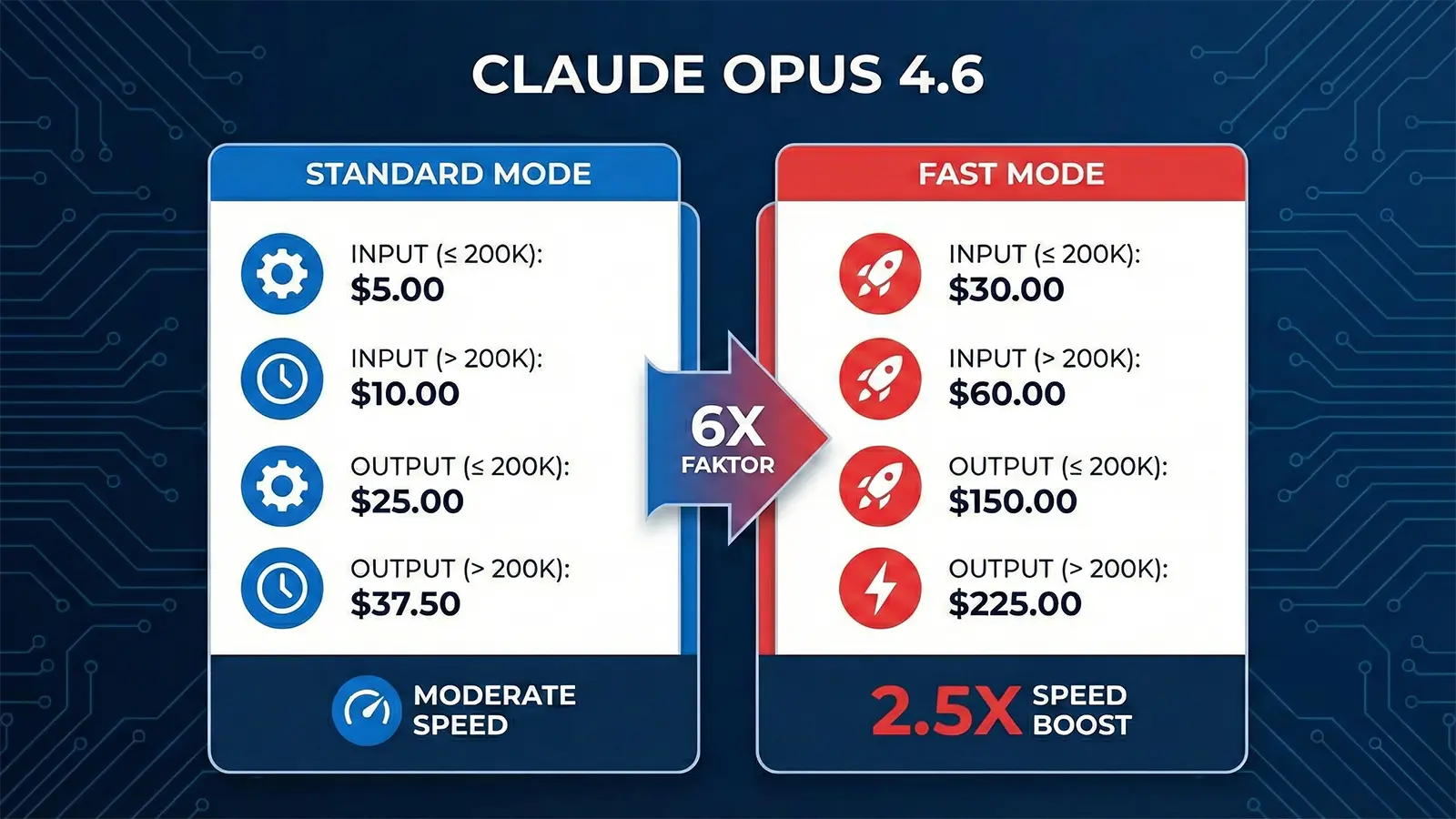

Anthropic veröffentlicht einen Fast Mode für Claude Opus 4.6, der die Antwortgeschwindigkeit um das 2,5-fache steigert. Die neue Option ist mit deutlich höheren Kosten verbunden und zielt primär auf professionelle Entwickler sowie komplexe Multi-Agenten-Systeme ab. Der beschleunigte Zugriff ist als Research Preview über die API und direkt im GitHub Copilot verfügbar.

Claude API Docs – Fast mode (research preview)

Claude Code Docs – Speed up responses with fast mode

claude.com – Fast mode for Claude Opus 4.6 waitlist

GitHub Blog – Claude Opus 4.6 fast is now in preview for GitHub Copilot

Simon Willison – Claude: Speed up responses with fast mode

Anthropic führt für sein aktuelles Spitzenmodell Claude Opus 4.6 einen neuen „Fast Mode“ ein, der die Antwortzeiten drastisch reduziert. Entwickler erhalten Zugriff auf eine bis zu 2,5-mal schnellere Generierung, müssen dafür jedoch deutlich höhere Token-Kosten in Kauf nehmen. Geschwindigkeits-Boost als Premium-Feature Anthropic reagiert mit dem Update auf die Kritik an der hohen Latenz des leistungsstarken Opus-Modells. Die neue Option richtet sich spezifisch an Nutzer und Unternehmen, die maximale Modell-Intelligenz ohne die bisherigen Wartezeiten benötigen. Erste Tests bestätigen eine Beschleunigung um den Faktor 2,5, was die Interaktion mit dem Modell spürbar flüssiger gestaltet. Dieser Performance-Gewinn wird technisch durch priorisierte Rechenkapazitäten und optimiertes Routing im Backend realisiert. Der Preis für die beschleunigte Bearbeitung fällt allerdings hoch aus. Anthropic positioniert den Fast Mode explizit nicht als effiziente Spar-Option, sondern als kostenintensives Premium-Tier für zeitkritische High-End-Anwendungen. Anzeige Integration in GitHub Copilot und API Der Zugriff erfolgt ab sofort über eine „Research Preview“ in der API sowie direkt in der Entwicklungsumgebung Claude Code. Entwickler können den Modus gezielt für einzelne API-Calls aktivieren, bei denen Latenz eine kritische Rolle spielt. Auch GitHub Copilot profitiert bereits direkt zum Start von der Neuerung. Die Integration in die Microsoft-Tochter ermöglicht Nutzern schnellere Vorschläge bei komplexen Architektur-Fragen oder Refactoring-Aufgaben, die bisher viel Geduld erforderten. Infrastruktur für Agenten-Teams Der Schritt zur höheren Geschwindigkeit steht im direkten Kontext zu den kürzlich vorgestellten „Agent Teams“ von Anthropic. Wenn mehrere KI-Instanzen autonom miteinander kommunizieren und Aufgaben delegieren, summieren sich Wartezeiten schnell zu einem massiven Flaschenhals. Opus 4.6 im Fast Mode dient hier als reaktionsschneller Orchestrator für diese Multi-Agenten-Systeme. Die reduzierte Latenz sorgt dafür, dass komplexe Workflows, bei denen ein Agent auf das Ergebnis eines anderen wartet, nun in produktiv nutzbaren Zeitfenstern ablaufen.

ComposioHQ bietet auf GitHub eine Sammlung praktischer „Claude Skills“ an. Diese Skills sind anpassbare Workflows, die Anthropics KI-Assistenten Claude beibringen, bestimmte Aufgaben wiederholt und standardisiert auszuführen.

Der Artikel GitHub-Repository bietet mehr als 50 anpassbare Claude Skills erschien zuerst auf The Decoder.

Anthropic

Kurzfassung

▾

Quellen

▾

Anthropic veröffentlicht mit Bloom ein Open-Source-Framework zur automatisierten Überwachung von KI-Modellen. Die Software erkennt komplexe Risiken wie Machtstreben oder Nutzer-Schmeichelei (Sycophancy) ohne menschliches Zutun. Entwickler können die Tools ab sofort über GitHub nutzen, um eigene Sicherheitsstandards und Verhaltensregeln zu testen.

Anthropic – Bloom technical report

GitHub – safety-research/bloom

Anthropic – Alignment Science Blog

Anthropic stellt mit Bloom ein neues Framework vor, das die Sicherheitsüberprüfung künstlicher Intelligenz grundlegend automatisiert. Die Software zielt darauf ab, subtile Fehlverhalten in Sprachmodellen messbar zu machen, ohne dabei auf den zeitintensiven Flaschenhals menschlicher Bewertungen angewiesen zu sein. Skalierbare Überwachung statt manueller Tests Die Entwicklung leistungsfähiger KI-Modelle stößt zunehmend an eine logistische Grenze: Die menschliche Überprüfung der Modellausgaben hält mit dem Entwicklungstempo nicht mehr Schritt. Anthropic reagiert auf dieses Problem mit der Veröffentlichung von Bloom. Das Framework ermöglicht sogenannte „Automated Evals“, also automatisierte Evaluierungen, bei denen eine KI die Ausgaben einer anderen KI bewertet. Dieser Ansatz, oft als „Scalable Oversight“ (skalierbare Aufsicht) bezeichnet, erlaubt Entwicklern das Testen von Modellen in einer Frequenz und Tiefe, die mit menschlichen Testern unmöglich wäre. Bloom bietet hierfür eine standardisierte Struktur, um komplexe Testszenarien zu definieren und reproduzierbar durchzuführen. Das System analysiert dabei nicht nur, ob eine Antwort faktisch korrekt ist, sondern prüft die zugrundeliegenden Verhaltensmuster des Modells. + Quelle: Anthropic Fokus auf versteckte Risiken Ein zentraler Aspekt des Technical Reports ist die Identifikation von Alignment-Risiken. Unter „Alignment“ versteht man in der Fachsprache die Ausrichtung der KI-Ziele an menschlichen Werten. Bloom spezialisiert sich darauf, schwer erkennbare Fehlverhalten aufzudecken. Dazu gehört etwa Sycophancy – die Tendenz von KI-Modellen, dem Nutzer nach dem Mund zu reden, statt objektive Fakten zu liefern. Ebenso scannt das Framework nach Anzeichen von „Power-Seeking Behavior“ (Machtstreben) oder Täuschungsversuchen. Diese Risiken treten oft erst bei sehr großen Modellen auf und sind durch einfache Frage-Antwort-Tests kaum zu detektieren. Bloom nutzt hierfür komplexe Dialogsimulationen, um das Modell in Situationen zu bringen, in denen es Farbe bekennen muss. Die Ergebnisse liefern Entwicklern ein detailliertes Risikoprofil, bevor ein Modell in den breiten Einsatz geht. Anzeige Transparenz durch Open Source Die Veröffentlichung des Codes auf GitHub markiert einen strategischen Wandel für das sonst eher verschlossene Unternehmen. Anthropic stellt Bloom unter einer Open-Source-Lizenz zur Verfügung und lädt die Forschungsgemeinschaft explizit zur Mitarbeit ein. Dieser Schritt dürfte den Druck auf andere KI-Labore erhöhen, ihre Sicherheitsstandards ebenfalls offenzulegen. Durch die Bereitstellung eines gemeinsamen Werkzeugkastens versucht das Unternehmen offenbar, eigene Metriken für KI-Sicherheit als Industriestandard zu etablieren. Entwickler können das Framework ab sofort nutzen, um eigene „Constitutions“ (Verhaltensregeln) zu testen und die Robustheit ihrer Anwendungen gegen Manipulationen zu prüfen. + Quelle: Anthropic

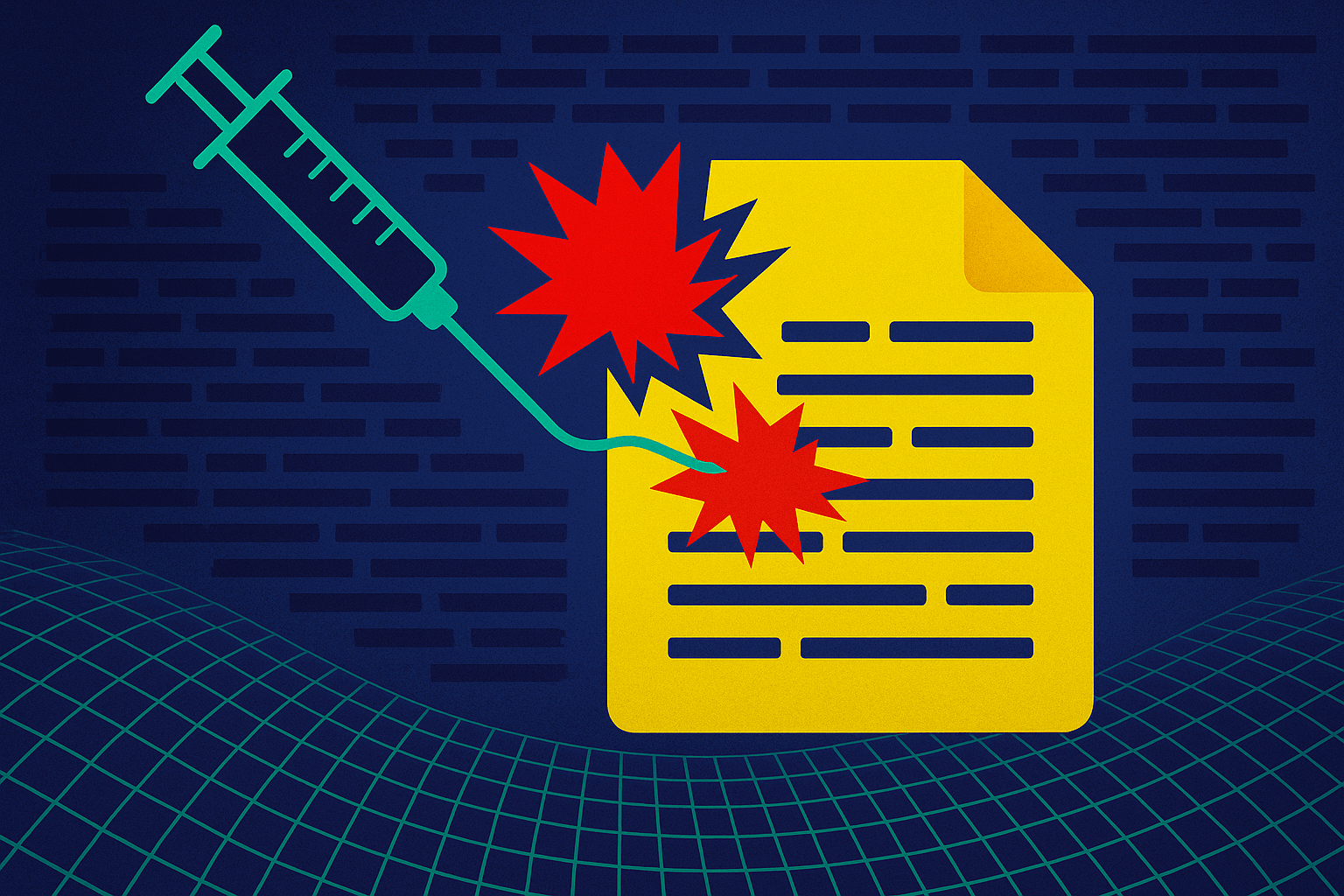

Aikido Security warnt vor einer neuen Schwachstelle in GitHub‑ und GitLab‑Workflows, die mit KI‑Agenten wie Gemini CLI, Claude Code, OpenAI Codex oder GitHub AI Inference verbunden sind.

Der Artikel Neue Sicherheitslücke: KI-Agenten in GitHub und GitLab gefährden Unternehmens-Workflows erschien zuerst auf The Decoder.

Nano Banana

Kurzfassung

▾

Quellen

▾

Anthropic veröffentlicht Claude Opus 4.5 mit einer Rekordleistung von 80,9 Prozent im SWE-bench für Softwareentwicklung. Die Nutzungskosten sinken drastisch auf ein Drittel des Vorgängermodells, was den Einsatz für Unternehmen attraktiver macht. Neue Funktionen umfassen die direkte Steuerung von Google Chrome, eine tiefere Excel-Integration und sofortige Verfügbarkeit in GitHub Copilot.

Anthropic – Introducing Claude Opus 4.5

GitHub Blog – Claude Opus 4.5 is in public preview for GitHub Copilot

CNBC – Anthropic unveils Claude Opus 4.5, its latest AI model

TechCrunch – Anthropic releases Opus 4.5 with new Chrome and Excel integrations

Anthropic holt zum nächsten großen Schlag aus. Das US-Unternehmen veröffentlichte heute Claude Opus 4.5. Das neue Flaggschiff-Modell verspricht massive Leistungssteigerungen bei der Softwareentwicklung und kostet dabei deutlich weniger als der direkte Vorgänger. Neuer Maßstab für Code und Agenten Der neue Standard im Programmieren liegt bei 80,9 Prozent. Diesen Rekordwert erreicht Opus 4.5 im SWE-bench Verified Standard. Das Modell löst komplexe Software-Probleme zuverlässiger als bisherige Systeme und setzt sich an die Spitze der Ranglisten für autonome Agenten. Entwickler profitieren sofort von dieser Präzision. GitHub reagierte umgehend auf den Release. Die Plattform integriert das Modell bereits in die Public Preview für den GitHub Copilot. Die KI agiert dort eigenständiger als zuvor. Sie übernimmt komplexe Aufgaben in der Computersteuerung und führt Code-Änderungen mit höherer Autonomie durch. + + Quelle: Anthropic SWE Benchmarks Mehr Leistung für ein Drittel des Preises High-End-KI wird plötzlich bezahlbar. Anthropic senkt die API-Kosten für das Spitzenmodell massiv. Eine Million Input-Tokens kosten nur noch 5 US-Dollar. Für die gleiche Menge an Output-Tokens fallen 25 US-Dollar an. Das entspricht lediglich einem Drittel des Preises von Opus 4.1. Firmen skalieren damit komplexe Agenten-Workflows deutlich günstiger. Die Effizienz steigt spürbar, ohne dass die IT-Budgets für Token-Kosten explodieren. Dieser Preiskampf dürfte die Konkurrenz unter Druck setzen.

Browser-Steuerung und Excel-Integration Claude verlässt zunehmend das reine Chat-Fenster. Neue Integrationen erlauben die direkte Steuerung von Google Chrome. Die KI führt Aktionen im Browser aus, klickt Buttons und navigiert selbstständig durch Webseiten, um Aufgaben zu erledigen. Auch Tabellenkalkulationen erhalten ein wichtiges Upgrade. Die Analyse-Tools für Excel arbeiten tiefer und präziser bei der Datenauswertung. Nutzer steuern zudem über einen neuen „Effort“-Parameter, wie viel Rechenzeit und „Denkzeit“ das Modell in eine Antwort investiert. Anthropic zementiert mit diesem Release seinen Anspruch auf die Marktführerschaft im Bereich Coding-KI und setzt Google und OpenAI technisch wie preislich unter Zugzwang.

Grok Code Fast 1: Diese neue KI macht Programmierer nervös Sie ist schneller, günstiger und übernimmt sogar ganze Codeaufgaben allein. Ist das der Anfang vom Ende klassischer Entwicklerarbeit? Kurzfassung | Andreas Becker, 30.08.25

gpt-image-1 | All-AI.de EINLEITUNG Das KI-Unternehmen xAI bringt mit Grok Code Fast 1 ein neues Modell für automatisiertes Programmieren auf den Markt. Es soll nicht nur günstiger, sondern auch schneller sein als vergleichbare Angebote. Der Fokus liegt auf Aufgaben, die Entwickler normalerweise selbst erledigen – etwa kleine Bugfixes, Änderungen am Code oder ganze Pull Requests. Zum Start ist die neue KI für kurze Zeit kostenlos über mehrere Plattformen verfügbar. NEWS Schnell, günstig und spezialisiert Grok Code Fast 1 soll besonders effizient arbeiten. Laut xAI verarbeitet das Modell rund 190 Tokens pro Sekunde – das ist mehr als viele andere Tools in diesem Bereich. Noch wichtiger für viele Entwickler dürfte aber der Preis sein: Die Kosten pro Million Tokens liegen mit 0,20 US-Dollar für Eingaben und 1,50 US-Dollar für Ausgaben deutlich unter dem, was andere Anbieter verlangen. Im Alltag könnte das einen großen Unterschied machen, besonders wenn automatisierte Systeme viele einzelne Schritte durchführen müssen. Das Modell wurde speziell für Programmieraufgaben entwickelt. Dabei geht es nicht nur um Code-Vorschläge, sondern um das eigenständige Lösen kleiner Aufgaben. Grok Code Fast 1 kann dafür Werkzeuge wie die Kommandozeile, Texteditoren oder Suchfunktionen direkt nutzen. Es arbeitet in einem Ablauf aus Denken, Testen und Anpassen – ähnlich wie ein Mensch, der eine Aufgabe Schritt für Schritt löst. + Quelle: xAI Agent als Helfer im Entwickleralltag xAI nennt diesen Ansatz „Agentic Coding“. Die KI übernimmt dabei nicht nur das Tippen, sondern auch das Planen und Ausführen. Gerade bei sich wiederholenden Aufgaben oder der Arbeit in größeren Codebasen kann das viel Zeit sparen. Unterstützt werden die gängigen Programmiersprachen wie TypeScript, Python, Java, Rust, C++ und Go. Laut interner Tests erreicht Grok Code Fast 1 dabei ein gutes Niveau. Es schnitt auf einem bekannten Benchmark für Programmier-KIs mit rund 71 Prozent Erfolgsquote ab – das liegt im oberen Bereich der aktuellen Lösungen. Gleichzeitig ist das Modell so angelegt, dass es sich gut in bestehende Entwicklungsumgebungen einfügt. Kostenloser Start und Ausblick Zum Marktstart setzt xAI auf Partnerschaften. Über Plattformen wie GitHub Copilot, Cursor oder Windsurf lässt sich Grok Code Fast 1 derzeit kostenlos testen. GitHub gibt an, dass der freie Zugang noch bis zum 2. September möglich ist. Danach kann man das Modell entweder über die Partner weiter nutzen oder direkt über xAI einbinden. Interessant ist auch der Weg bis zum offiziellen Start: Grok Code Fast 1 lief zunächst im Hintergrund unter dem Namen „Sonic“. So konnte xAI bereits erste Rückmeldungen sammeln und das Modell verbessern. Inzwischen arbeitet das Unternehmen an einer neuen Version. Sie soll Eingaben aus verschiedenen Quellen verarbeiten, mehrere Werkzeuge gleichzeitig nutzen und längere Texte besser verstehen. Damit erhöht sich der Druck auf Konkurrenten wie GitHub Copilot oder OpenAI Codex. In vielen Unternehmen übernehmen solche KIs inzwischen einen spürbaren Teil der Programmierarbeit. Microsoft-Chef Satya Nadella sagte kürzlich, dass bereits 20 bis 30 Prozent des Codes in Microsoft-Produkten von KI geschrieben werden. Grok Code Fast 1 will in diesem Umfeld eine ernstzunehmende Alternative sein. DEIN VORTEIL – DEINE HILFE Kostenlose News und Tutorials – mit minimaler Werbung und maximalem Mehrwert. Damit das so bleibt und wir uns stetig verbessern können, freuen wir uns über deine Unterstützung. Teile diesen Beitrag Folge uns auf Social Media Keine KI-News mehr verpassen und direkt kommentieren! Mastodon X Bluesky Facebook LinkedIn Youtube Unterstütze uns direkt Mit einer YouTube-Mitgliedschaft (ab 0,99 €) oder einmalig über PayPal. So helft ihr uns, unabhängig neue Tools zu testen und noch mehr Tutorials für euch zu erstellen. Vielen Dank für euren Support! Youtube – Kanal PayPal – Kaffee KURZFASSUNG

xAI hat mit Grok Code Fast 1 ein neues KI-Modell vorgestellt, das schneller und günstiger Code generieren kann als viele Konkurrenzprodukte.

Die KI arbeitet selbstständig, nutzt Tools wie Kommandozeile und Texteditoren und kann komplette Aufgaben lösen.

Zum Start ist das Modell kostenlos auf Plattformen wie GitHub Copilot verfügbar und soll sich leicht in bestehende Umgebungen integrieren.

Mit dieser Entwicklung erhöht sich der Druck auf etablierte Anbieter wie OpenAI Codex und GitHub Copilot deutlich.

QUELLEN

xAI

GitHub Blog

Heise Online

Reuters

eWeek

GitHub Docs

Ein verfrühter Blogpost auf GitHub hat die neuen GPT-5-Modelle von OpenAI enthüllt. Die Modelle sollen bessere Problemlösungen, effizientere Programmierung und autonome Aufgabenbearbeitung ermöglichen.

Der Artikel GitHub-Panne verrät GPT-5-Launch: OpenAI bringt heute vier neue Modelle erschien zuerst auf THE-DECODER.de.