Nano Banana

Kurzfassung

▾

Quellen

▾

Das Jahr 2026 markiert den technologischen Durchbruch von KI-Agenten, die komplexe Aufgaben wie Reisebuchungen völlig autonom und ohne manuelle App-Wechsel erledigen. Humanoide Roboter erreichen durch das Verfahren der verkörperten Intelligenz die Serienreife für den Einsatz in Haushalten und in der Pflege. Große Plattformen wie Amazon integrieren externe Dienstleister tief in ihre Sprachassistenten, um den Übergang von reiner Information zu echtem Handeln zu vollziehen. Die Branche erwartet zudem eine Welle von Börsengängen und signifikante Fortschritte in der medizinischen Forschung durch beschleunigte Wirkstoffanalysen.

Inc.com – 7 Predictions for 2026, From Coffee-Making Humanoid Robots to AI Helping Treat Disease

TechCrunch – Equity’s 2026 Predictions: AI Agents, Blockbuster IPOs and the future of VC

MIT News – Computer science and technology

TechCrunch – Amazon’s AI assistant Alexa+ now works with Angi, Expedia, Square, and Yelp starting in 2026

The Verge – Tech News 2025/2026

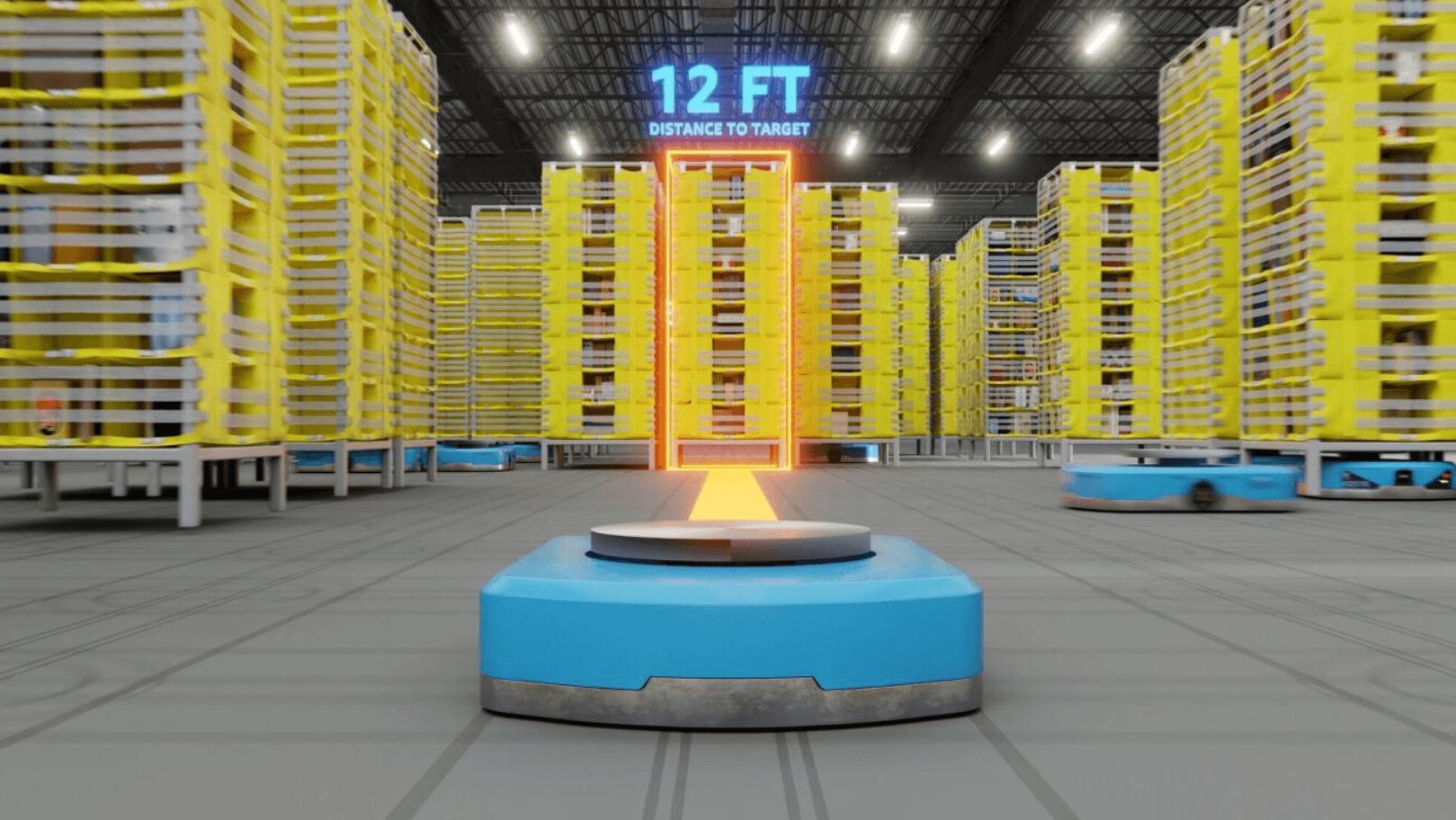

Das Jahr 2026 markiert den technologischen Wendepunkt von rein digitalen Chatbots hin zu physisch agierenden Helfern in Haushalt und Industrie. Für Nutzer bedeutet dieser Wandel den Einzug autonomer Systeme, die komplexe Aufgaben wie Reisebuchungen oder manuelle Tätigkeiten eigenständig bewältigen. Humanoide Roboter verlassen die Testlabore Der Traum vom künstlichen Haushaltsgehilfen wird im kommenden Jahr greifbare Realität. Führende Hersteller wie Unitree und Tesla skalieren ihre Produktion massiv, um humanoide Roboter für den kommerziellen Einsatz bereitzustellen. Während Modelle wie der Unitree H2 bereits durch ihre ultrarealistischen Bewegungsabläufe beeindrucken, liegt der Fokus für 2026 auf der Bewältigung einfacher Alltagsaufgaben. Diese Maschinen nutzen sogenanntes Embodied AI (verkörperte Intelligenz). Dabei lernt die Hardware durch Imitation menschlicher Bewegungen, wie man Kaffee zubereitet oder Werkzeuge bedient. Chinesische Anbieter wie BYD planen für das Jahr 2026 bereits mit einer Produktion von bis zu 20.000 Einheiten. Die Preise für diese Systeme sinken kontinuierlich, was den Einsatz in privaten Haushalten und kleineren Betrieben wirtschaftlich attraktiv macht. Anzeige Agentische KI übernimmt die digitale Organisation Parallel zur Hardware entwickeln sich digitale Assistenten zu autonomen Agenten weiter. Ein KI-Agent bezeichnet Programme, die nicht nur Fragen beantworten, sondern eigenständig Handlungen in anderen Anwendungen ausführen. Amazon treibt diese Entwicklung mit dem Dienst Alexa+ voran, der ab 2026 tief in Plattformen wie Expedia, Yelp und Square integriert ist. Nutzer müssen keine separaten Apps mehr öffnen, um einen Flug zu buchen oder einen Handwerkertermin zu koordinieren. Die künstliche Intelligenz verhandelt im Hintergrund Verfügbarkeiten und schließt Buchungen nach einer kurzen Bestätigung ab. Durch das Verständnis von Kontext und persönlichen Vorlieben agieren diese Systeme wie ein persönlicher Sekretär, der komplexe, mehrstufige Prozesse ohne manuelles Eingreifen steuert. Durchbrüche in der Medizin und am Finanzmarkt Auch in hochspezialisierten Bereichen wie der Medizin sorgt die Technologie für signifikante Fortschritte. KI-gestützte Analysen beschleunigen die Identifizierung neuer Wirkstoffe gegen Krankheiten, was die Entwicklungszyklen in der Pharmaindustrie drastisch verkürzt. Sensorgesteuerte Roboter unterstützen zudem in der Pflege, indem sie Vitaldaten überwachen oder körperlich schwere Arbeiten beim Patiententransport übernehmen. Wirtschaftlich steht der Branche ein ereignisreiches Jahr bevor. Experten erwarten eine Welle von Börsengängen (IPOs) großer KI-Startups, da der Druck auf Investoren zur Realisierung von Gewinnen steigt. Dieses frische Kapital wird voraussichtlich die Forschung an noch effizienteren, lokal laufenden Modellen befeuern. Die Technologie verliert dadurch ihren Status als reines Hype-Thema und festigt sich als tragende Säule der globalen Infrastruktur.