Nano Banana

Kurzfassung

▾

Quellen

▾

Microsoft hat mit Copilot Health einen spezialisierten KI-Assistenten für persönliche Gesundheitsdaten vorgestellt.

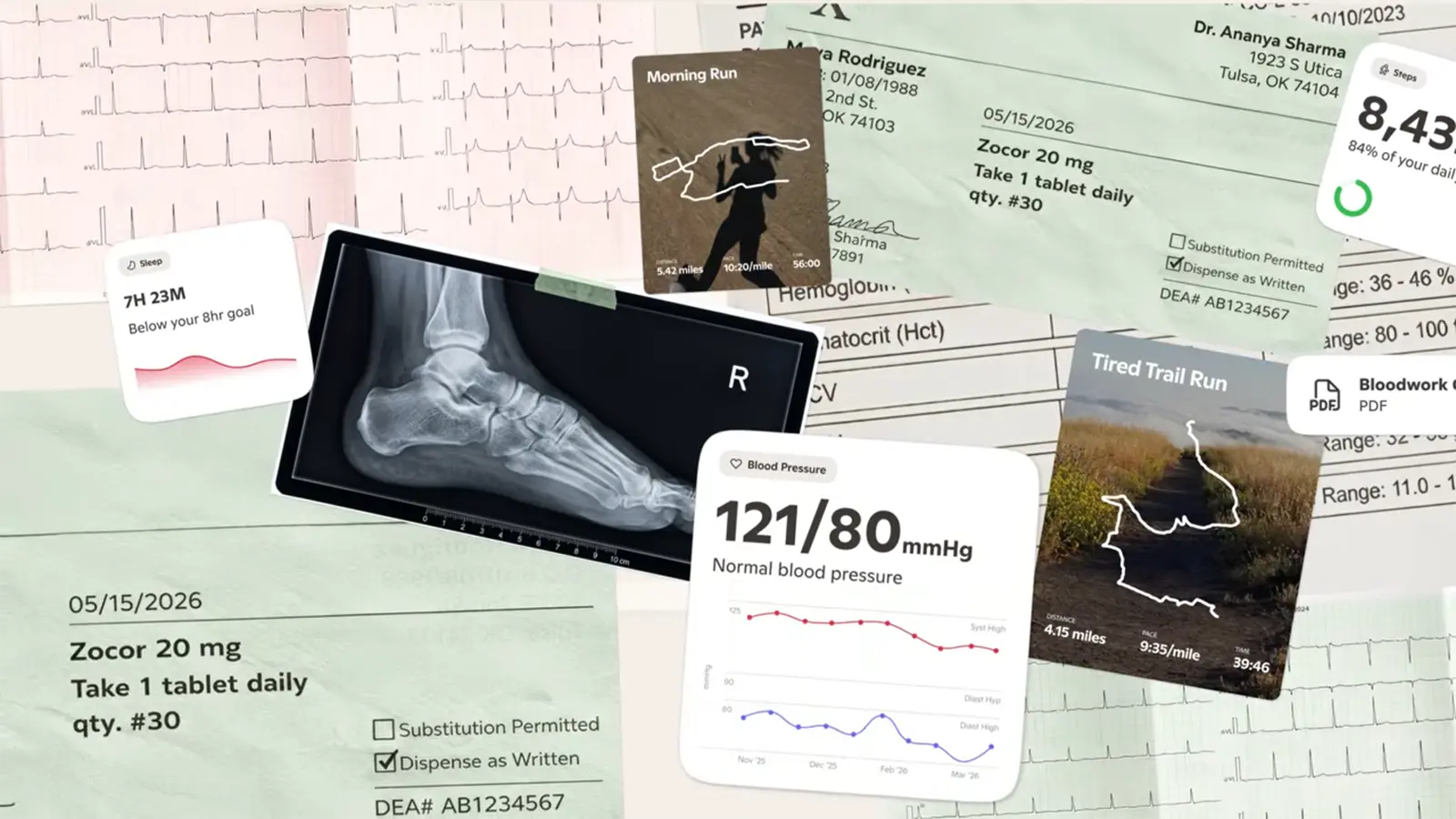

Das System bündelt Vitalwerte von Wearables wie der Apple Watch und verknüpft diese mit elektronischen Patientenakten sowie Laborergebnissen.

Die KI dient nicht der Diagnose, sondern übersetzt medizinische Fachsprache und bereitet Anwender auf den Arztbesuch vor.

Aus Datenschutzgründen arbeitet der Assistent in einer isolierten Umgebung, in der die Daten nicht für das Training von KI-Modellen verwendet werden.

Microsoft AI: Introducing Copilot Health

Microsoft erweitert seinen KI-Assistenten um einen dedizierten Gesundheitsbereich. Copilot Health führt Daten von Smartwatches, Laborergebnissen und Arztbriefen zusammen, um komplexe medizinische Informationen für Anwender verständlich aufzubereiten. Datenaggregation statt Diagnostik Der neue KI-Assistent fungiert als zentraler Knotenpunkt für verstreute Gesundheitsinformationen. Nutzer können über Schnittstellen (APIs) ihre Fitness-Tracker wie die Apple Watch, Oura-Ringe oder Fitbit-Geräte anbinden. Zusätzlich integriert das System über den Drittanbieter HealthEx elektronische Patientenakten, Medikamentenpläne und Laborwerte von über 50.000 US-Krankenhäusern. Die KI nutzt ihre Reasoning-Fähigkeiten, um diese Rohdaten zu strukturieren und in einen logischen Kontext zu setzen. So lassen sich beispielsweise Zusammenhänge zwischen den aufgezeichneten Schlafphasen und aktuellen Vitalwerten ermitteln. Das Ziel der Software ist es ausdrücklich nicht, den Arztbesuch zu ersetzen oder eigenständige Diagnosen zu stellen. Vielmehr bereitet die KI den Patienten auf das anstehende Gespräch mit dem Mediziner vor. Anwender nutzen gezielte Prompts, um sich komplexe medizinische Fachbegriffe aus ihren eigenen Akten einfach erklären zu lassen.

Strikte Trennung der Gesundheitsdaten Ein zentraler Aspekt der Neuentwicklung ist der Datenschutz. Copilot Health arbeitet in einer vollständig isolierten Umgebung. Die KI ist technisch strikt vom regulären Copilot getrennt. Die eingegebenen Gesundheitsdaten und Chat-Verläufe fließen nicht in das Training zukünftiger Modelle ein. Anwender behalten die volle Kontrolle über ihre persönlichen Informationen und können diese jederzeit restlos löschen. Anzeige Hoher Bedarf an medizinischer Einordnung Die Nachfrage nach gesundheitlicher Aufklärung durch künstliche Intelligenz ist hoch. Täglich verarbeiten die bestehenden Dienste des Unternehmens bereits rund 50 Millionen gesundheitsbezogene Suchanfragen. Fast ein Fünftel der bisherigen Interaktionen mit dem Standard-Copilot umfassen persönliche Symptome oder die Interpretation von Testergebnissen. Häufig suchen Anwender dabei nicht nur Informationen für sich selbst, sondern auch für Familienangehörige. Der neue Assistent greift auf verifizierte medizinische Datenbanken zurück, um fehlerhafte Antworten zu minimieren. Der Startschuss für Copilot Health fällt zunächst in den USA. Erwachsene ab 18 Jahren können sich dort auf eine Warteliste für die englischsprachige Version setzen lassen. Mit diesem Vorstoß betritt der Konzern einen stark umkämpften Markt, in dem auch OpenAI mit ChatGPT Health und Amazon mit ähnlichen KI-Lösungen aktiv sind.