Nano Banana

Kurzfassung

▾

Quellen

▾

Google erweitert den AI Mode in Chrome um eine Side-by-Side-Ansicht für den Desktop.

Webseiten und der KI-Chat lassen sich nun parallel in einem Fenster nutzen.

Ein neues Plus-Menü erlaubt zudem die Kombination mehrerer geöffneter Tabs in einer Suchanfrage.

Die Modelle verarbeiten dabei gleichzeitig Texte, Bilder und PDF-Dokumente.

Google Blog: A new way to explore the web with AI Mode in Chrome

Google integriert den AI Mode tiefer in den Chrome-Browser und ermöglicht eine parallele Nutzung von Webseiten und KI auf quasi einer Browser-Oberfläche. Anwender können im Browser direkt neben den Ergebnissen mit Inhalten interagieren, ohne den Tab wechseln zu müssen.

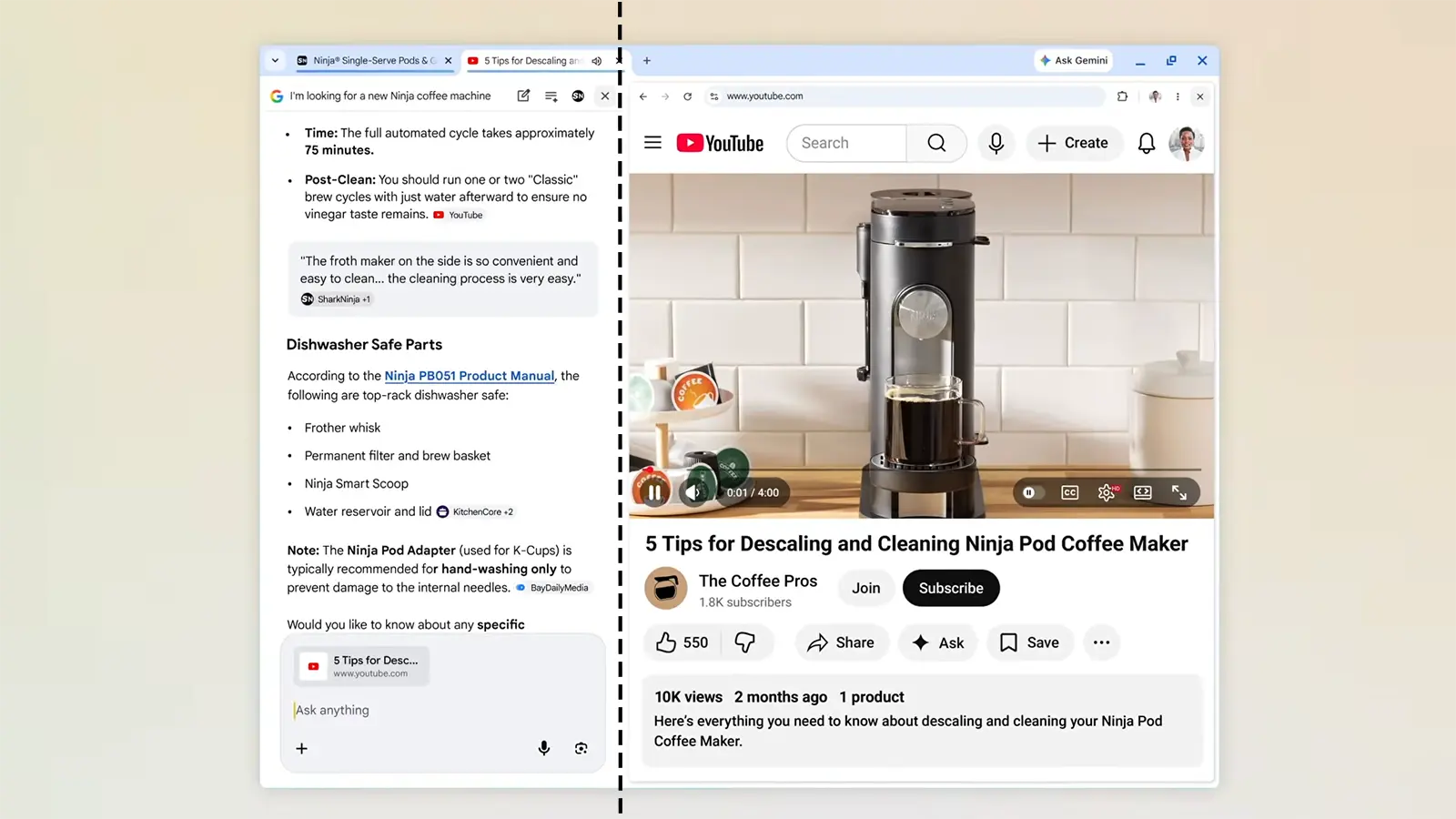

Nahtloser Kontext auf dem Desktop Klickt ein Nutzer im AI Mode auf einen Link, öffnet sich die Webseite in einer geteilten Ansicht direkt neben dem Chat. Das ständige Wechseln zwischen verschiedenen Tabs entfällt dadurch. Die KI behält den inhaltlichen Kontext der aufgerufenen Seite bei. So lassen sich spezifische Rückfragen zu einem langen Artikel oder einem Produkt stellen. Die Modelle analysieren den Text der aktuellen Webseite und kombinieren diese konkreten Informationen mit dem generellen Wissen aus dem Netz. Anzeige Suche über mehrere Tabs hinweg Eine zusätzliche Neuerung betrifft die direkte Einbindung bestehender Informationen. Über ein neues Plus-Menü auf der Startseite oder im AI Mode lassen sich bereits geöffnete Tabs in eine neue Suchanfrage integrieren. Diese Funktion steht sowohl in der Desktop-Version als auch in der mobilen Chrome-App bereit. Nutzer kombinieren dabei verschiedene Eingabeformate sehr flexibel in einem einzigen Prompt. Die Modelle verarbeiten nun gleichzeitig ausgewählte Tabs, hochgeladene Bilder oder lokale PDF-Dokumente. Die KI zieht die Fakten aus all diesen Quellen heran, um beispielsweise komplexe Zusammenhänge zwischen verschiedenen Vorlesungsskripten zu erklären. Über das gleiche Menü erhalten Anwender zudem schnellen Zugriff auf Funktionen wie Canvas oder die Bilderstellung. Die Erweiterungen für den AI Mode stehen in den USA ab sofort zur Verfügung, weitere Länder sollen zeitnah folgen.